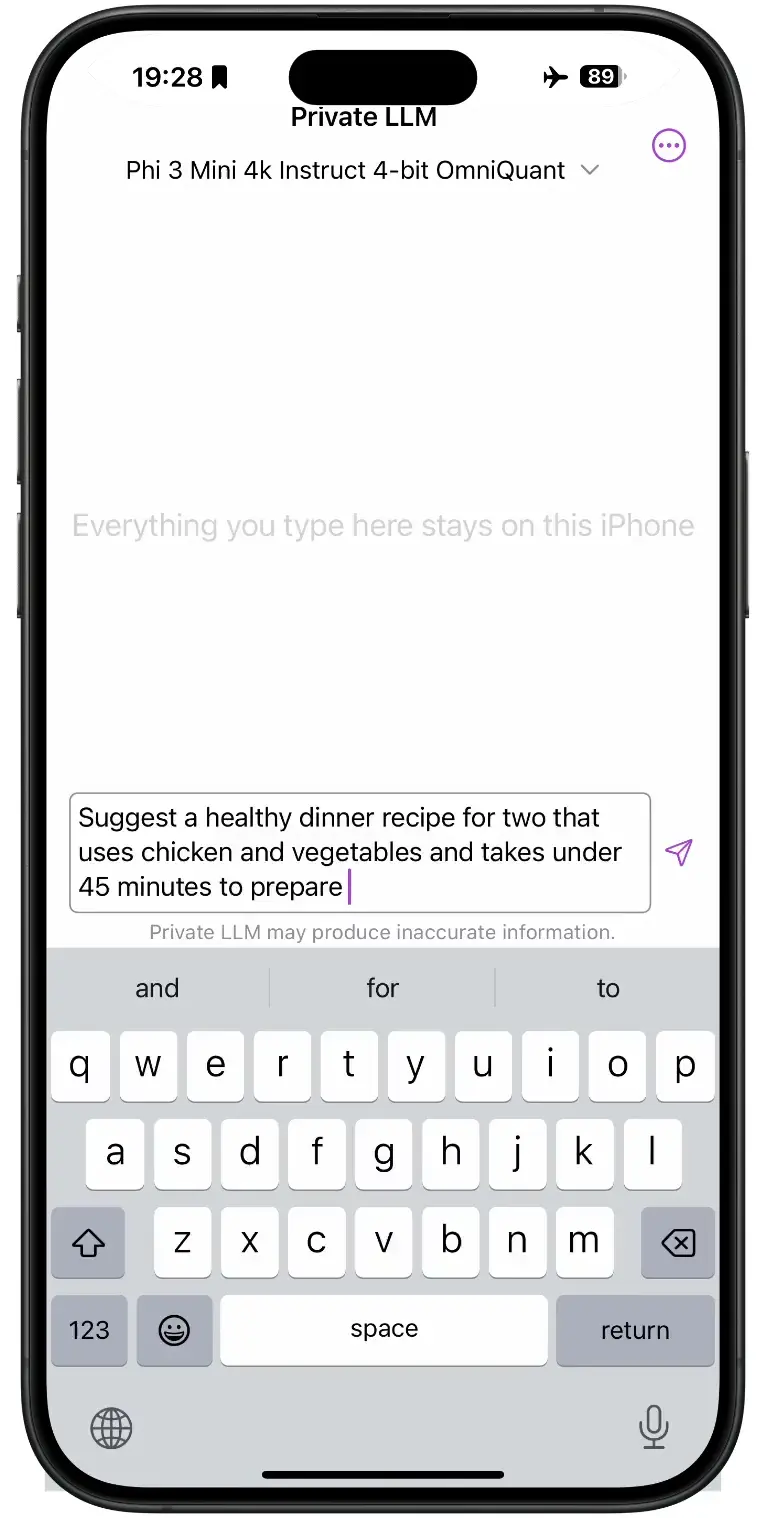

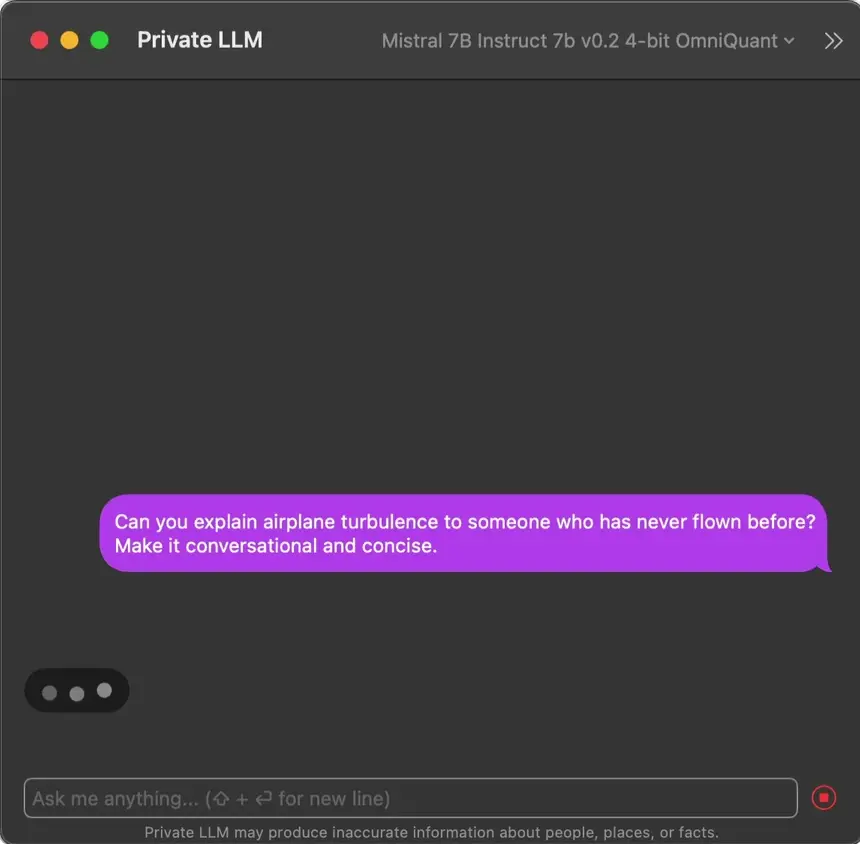

Private LLM Chat IA privé et non censuré pour iPhone, iPad et Mac

Pas de Cloud, Pas de Suivi, Pas de Connexions.

Utilisez l'IA hors ligne sur votre iPhone, iPad et Mac

Private LLM fonctionne entièrement sur votre iPhone, iPad ou Mac. Vos conversations ne quittent jamais l'appareil, et aucune connexion internet n'est requise après le premier téléchargement du modèle. Pas de compte, pas de suivi, pas de journaux. Un seul achat débloque l'application sur tous les appareils Apple que vous possédez et pour votre groupe de Partage familial.

Faites tourner DeepSeek R1, Llama 3.3, Qwen3 et Gemma 3 en local

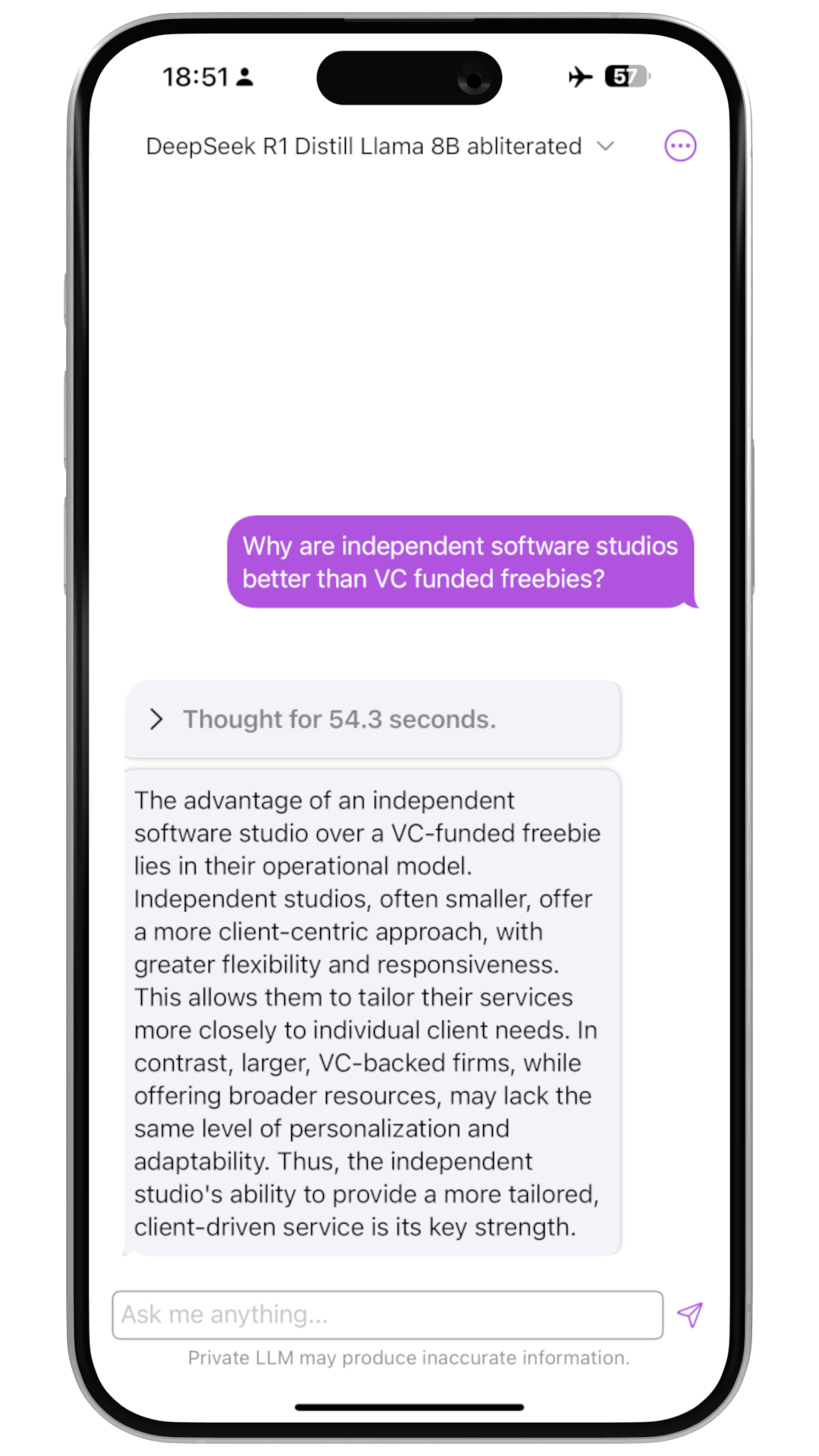

Private LLM fait tourner les meilleurs modèles open-source directement sur vos appareils Apple - DeepSeek R1 Distill, Llama 3.3 70B, Qwen3 4B, Phi 4, Google Gemma 3, et bien plus. Chaque conversation reste sur l'appareil, et chaque modèle est quantifié en interne pour la meilleure qualité possible sur votre matériel.

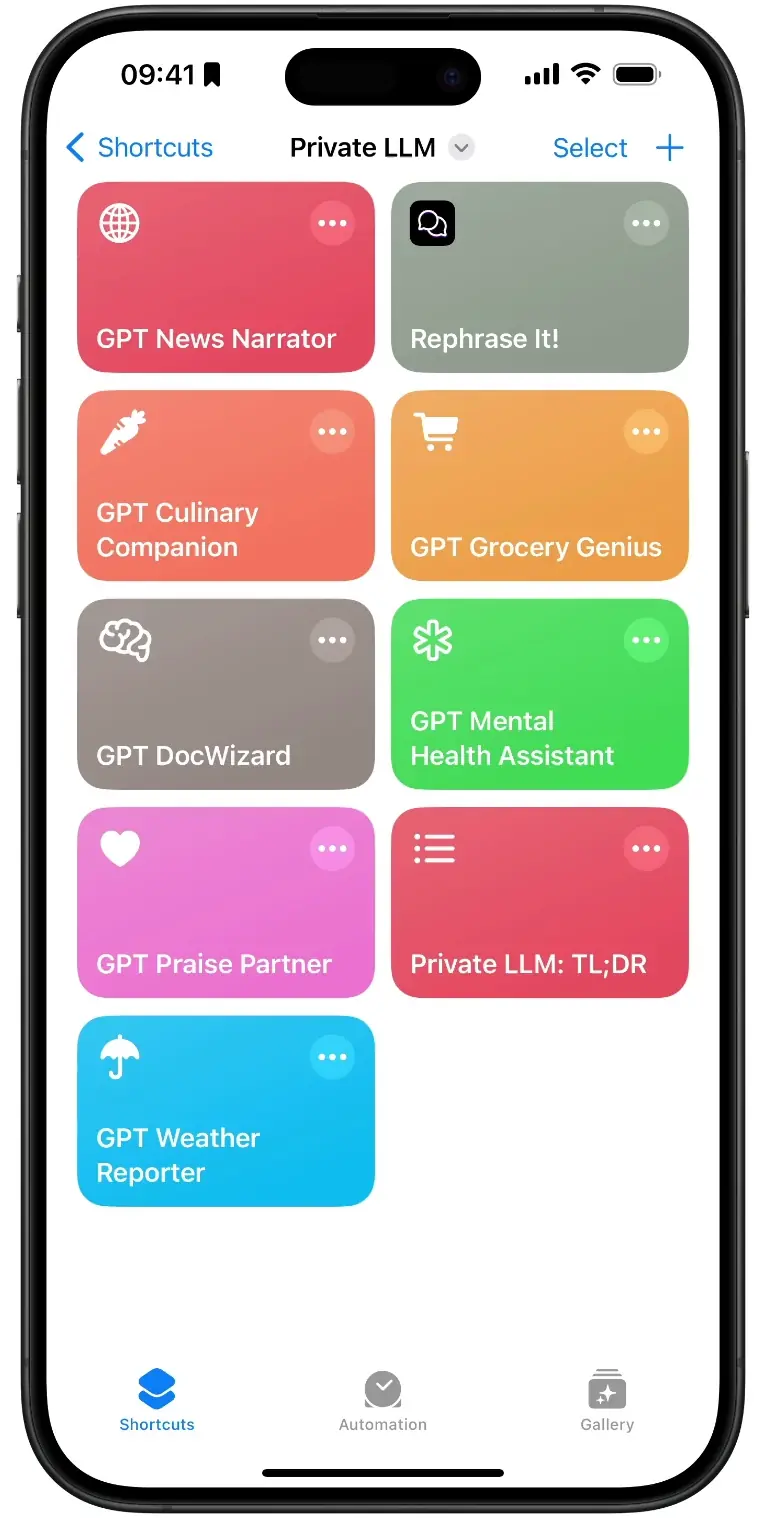

IA locale dans Siri et Apple Shortcuts - Sans code

Private LLM s'intègre directement à Siri et à l'application Raccourcis. Créez des flux de travail basés sur l'IA qui résument du texte, génèrent de la rédaction ou transmettent des réponses vers n'importe laquelle des 70+ applications prenant en charge la spécification x-callback-url. Aucun code requis.

Un seul achat, sans abonnement - Partage familial pour six

Abandonnez les abonnements pour un choix plus judicieux avec Private LLM. Un seul achat débloque l'application sur toutes les plateformes Apple—iPhone, iPad, et Mac—tout en activant le Partage familial pour jusqu'à six membres de la famille. Cette approche non seulement simplifie l'accès mais amplifie également la valeur de votre investissement, rendant la confidentialité numérique et l'intelligence universellement disponibles dans votre famille.

Outils de rédaction IA intégrés à macOS

Sélectionnez n'importe quel texte dans n'importe quelle application macOS, faites un clic droit, et Private LLM le réécrit, le résume ou le corrige - entièrement sur l'appareil. Prend en charge l'anglais et les principales langues d'Europe de l'Ouest.

Développé par deux ingénieurs, pas par des VC

Private LLM est développé par deux ingénieurs dans l'UE - autofinancé, sans financement par capital-risque, sans feuille de route axée sur le growth-hacking. Nous sommes la seule application sur l'App Store avec la quantification OmniQuant et GPTQ, qui produisent des résultats nettement meilleurs que la quantification RTN utilisée par les applications wrappers MLX et llama.cpp comme Ollama et LM Studio. Nous rendons des comptes aux utilisateurs, pas aux investisseurs - c'est pourquoi vos données restent sur l'appareil et le resteront toujours.

Depuis l'App Store

De vrais avis d'utilisateurs d'iPhone et de Mac

“This is a private AI app created by developers performing constant updates and not charging a subscription. That is rare nowadays! Bravo, looking forward to the updates as this continues to improve!”

Avis 1 sur 5

Quantification OmniQuant et GPTQ : Meilleurs résultats, moins de mémoire

Private LLM utilise la quantification OmniQuant et GPTQ. Lorsque les LLM sont quantifiés pour l'inférence sur l'appareil, les valeurs de poids aberrantes nuisent à la qualité de la génération de texte. OmniQuant module les poids aberrants avec un mécanisme d'écrêtage apprenable basé sur l'optimisation qui minimise l'erreur de quantification. GPTQ utilise des informations approximatives du second ordre (Hessien) pour minimiser l'erreur de reconstruction sur les poids les plus importants. La quantification RTN affine utilisée par les applications basées sur MLX comme LM Studio, et les variantes RTN par blocs utilisées par les applications basées sur llama.cpp comme Ollama, ignorent ce type d'optimisation par poids - c'est pourquoi ces applications produisent des résultats de moindre qualité sur le même matériel Apple. Nous explorons constamment des méthodes de quantification avancées, un travail que les applications wrappers basées sur des moteurs d'inférence tiers ne peuvent pas assumer. OmniQuant et GPTQ, associés à des noyaux Metal optimisés spécifiques aux modèles, permettent à Private LLM d'offrir une génération de texte à la fois rapide et de haute qualité sur le matériel Apple.

Téléchargez les Meilleurs LLMs Open Source

iOS

Modèles Basés sur Qwen3 4B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur DeepSeek R1 Distill

Pour iPhones/iPads avec 8GB+ de RAMModèles Basés sur DeepSeek R1 Distill

Pour iPhones/iPads avec 16GB+ de RAMModèles Basés sur Meta Llama 3.2 3B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur Meta Llama 3.2 1B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur Google Gemma 3 1B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur Google Gemma 2 9B

Pour iPhones/iPads avec 16GB+ de RAMModèles Basés sur Google Gemma 2 2B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur Meta Llama 3.1 8B

Pour iPhones/iPads avec 8GB+ de RAMModèles Basés sur Meta Llama 3 8B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur Qwen 2.5

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur Qwen 2.5

Pour iPhones/iPads avec 8GB+ de RAMModèles Basés sur Qwen 2.5

Pour iPhones/iPads avec 8GB+ de RAMModèles Basés sur Qwen 2.5 14B

Pour iPhones/iPads avec 16GB+ de RAMModèles Basés sur Phi-3 Mini 3.8B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur Mistral 7B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur Llama 2 7B

Pour iPhones/iPads avec 6GB+ de RAMModèles Basés sur Phi-2 3B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur H2O Danube

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur StableLM 3B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur TinyLlama 1.1B

Pour iPhones/iPads avec 4GB+ de RAMModèles Basés sur Yi 6B

Pour iPhones/iPads avec 6GB+ de RAMmacOS

Modèles Basés sur DeepSeek R1 Distill

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur DeepSeek R1 Distill

Pour Apple Silicon Macs avec 32GB+ de RAMModèles Basés sur DeepSeek R1 Distill

Pour Apple Silicon Macs avec 48GB+ de RAMModèles Basés sur Google Gemma 3 1B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Phi-4 14B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Meta Llama 3.3 70B

Pour Apple Silicon Macs avec 48GB+ de RAMModèles Basés sur Meta Llama 3.2 3B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Meta Llama 3.2 1B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Meta Llama 3.1 70B

Pour Apple Silicon Macs avec 64GB+ de RAMModèles Basés sur Meta Llama 3.1 8B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Qwen 2.5

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Qwen 2.5 14B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Qwen3 4B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Qwen 2.5 32B

Pour Apple Silicon Macs avec 24GB+ de RAMModèles Basés sur Google Gemma 2 9B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Google Gemma 2 2B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Meta Llama 3 70B

Pour Apple Silicon Macs avec 48GB+ de RAMModèles Basés sur Meta Llama 3 8B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Phi-3 Mini 3.8B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Google Gemma

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Mixtral 8x7B

Pour Apple Silicon Macs avec 32GB+ de RAMModèles Basés sur Llama 33B

Pour Apple Silicon Macs avec 24GB+ de RAMModèles Basés sur Llama 2 13B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur CodeLlama 13B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Llama 2 7B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Solar 10.7B

Pour Apple Silicon Macs avec 16GB+ de RAMModèles Basés sur Phi-2 3B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Mistral 7B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur StableLM 3B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Yi 6B

Pour Apple Silicon Macs avec 8GB+ de RAMModèles Basés sur Yi 34B

Pour Apple Silicon Macs avec 24GB+ de RAMComment pouvons-nous aider ?

Que vous ayez une question ou que vous rencontriez un problème avec Private LLM, nous sommes là pour vous aider. Remplissez simplement vos coordonnées dans le formulaire ci-dessous, et nous reviendrons vers vous dès que possible.