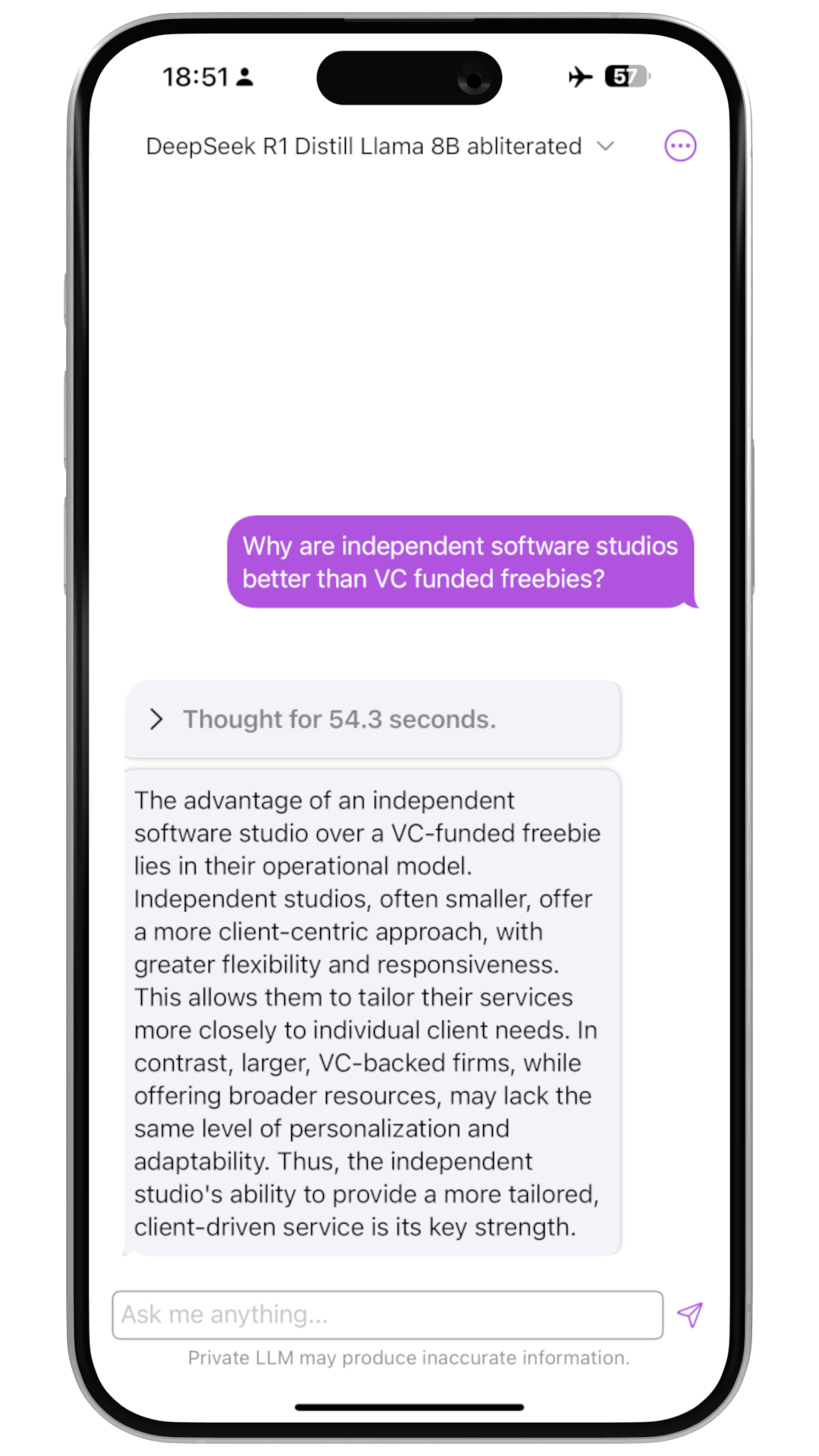

Private LLM Chat de IA privado e sem censura para iPhone, iPad e Mac

Sem nuvem, sem rastreamento, sem logins.

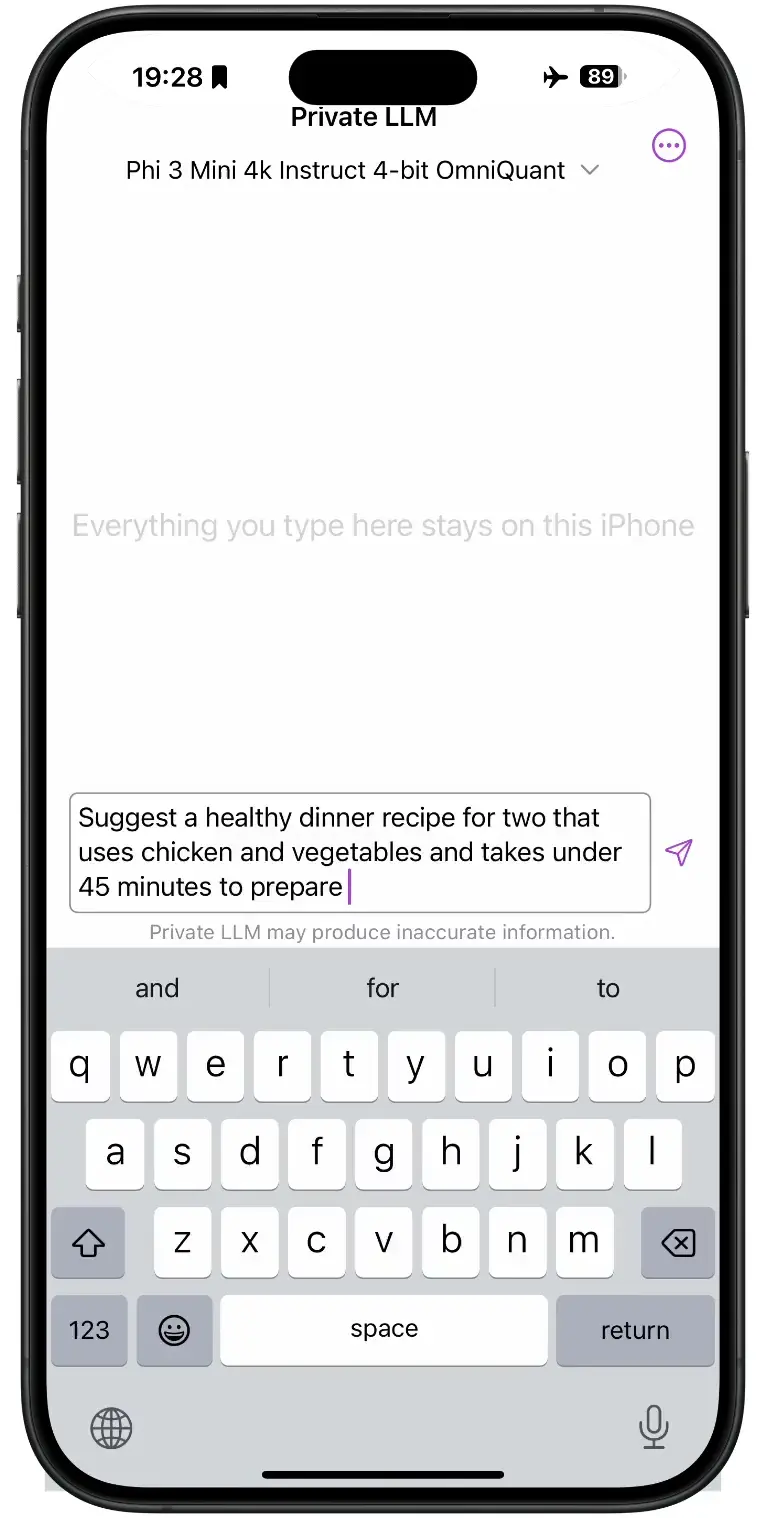

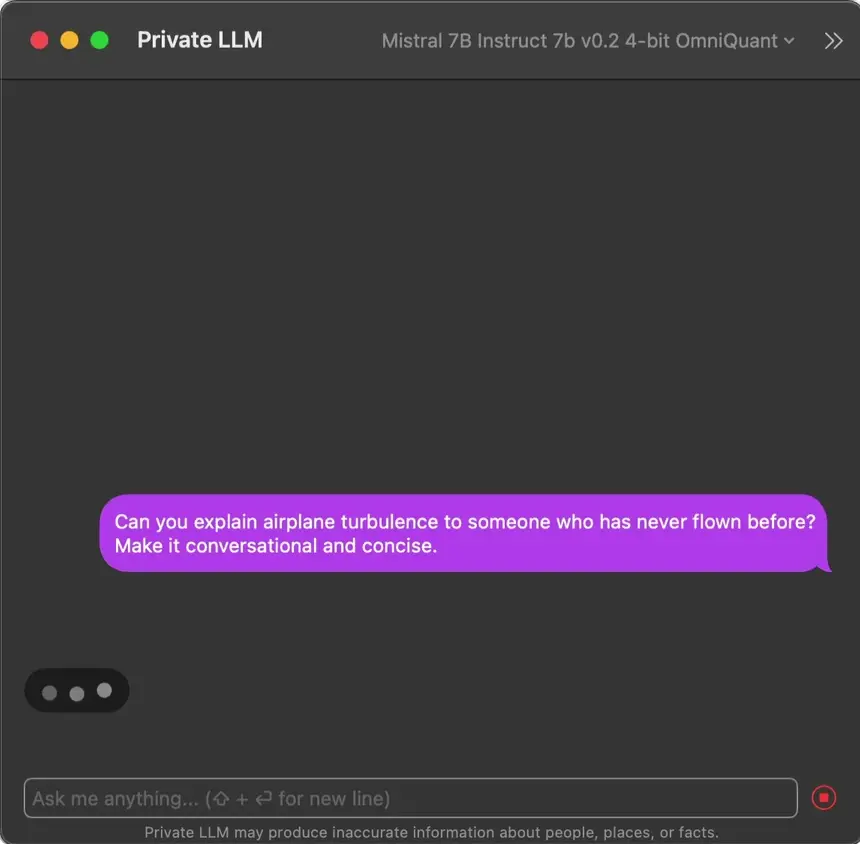

Execute IA offline no seu iPhone, iPad e Mac

O Private LLM roda inteiramente no seu iPhone, iPad ou Mac. Suas conversas nunca saem do dispositivo e não é necessária internet após o download inicial do modelo. Sem conta, sem rastreamento, sem logs. Uma compra desbloqueia o app em todos os seus dispositivos Apple e no seu grupo de Compartilhamento Familiar.

Execute DeepSeek R1, Llama 3.3, Qwen3 e Gemma 3 localmente

O Private LLM executa os principais modelos de código aberto diretamente nos seus dispositivos Apple — DeepSeek R1 Distill, Llama 3.3 70B, Qwen3 4B, Phi 4, Google Gemma 3 e mais. Cada conversa permanece no dispositivo e cada modelo é quantizado internamente para a melhor qualidade possível no seu hardware.

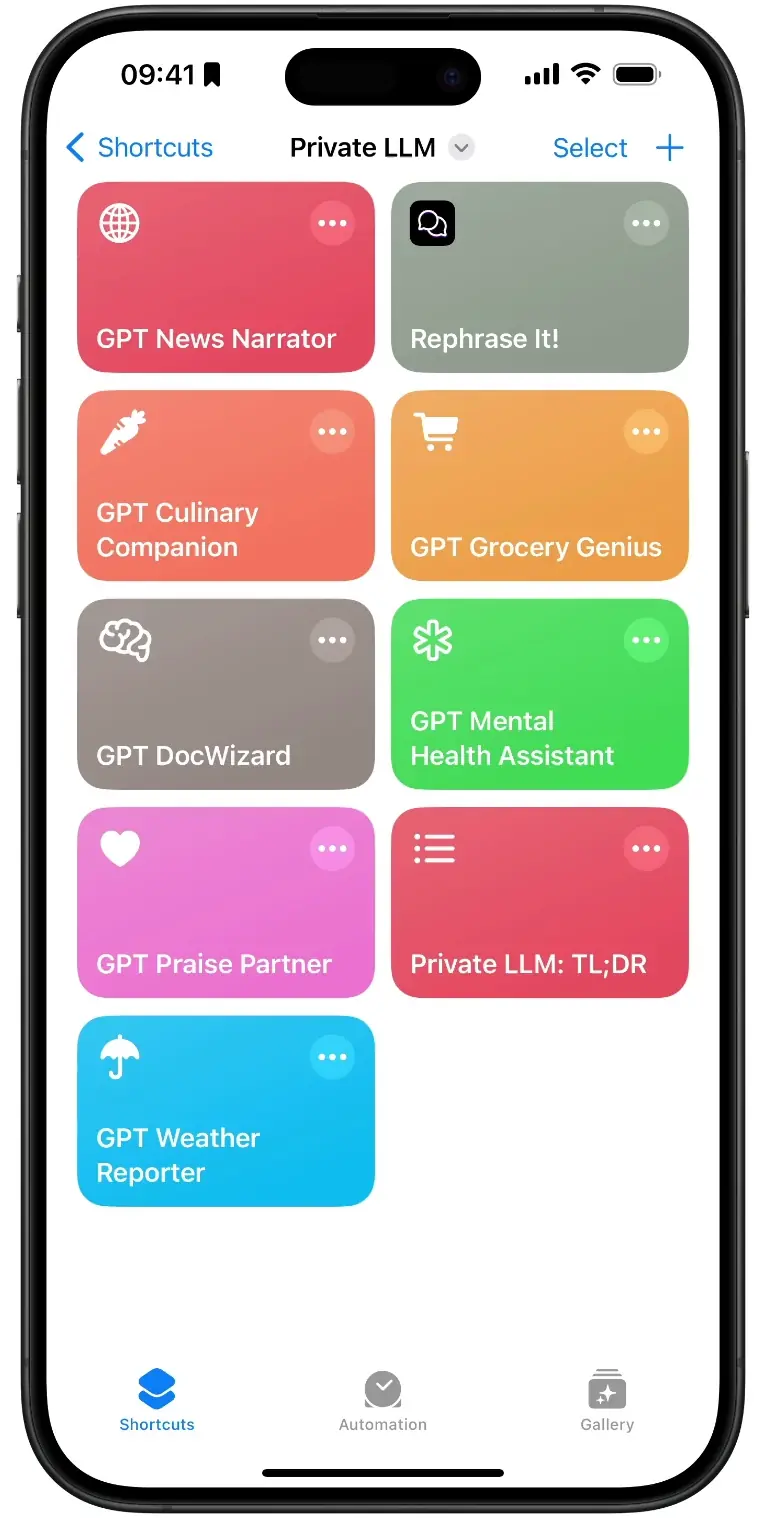

IA local no Siri e Apple Shortcuts — Sem código

O Private LLM se conecta diretamente ao Siri e ao app Shortcuts. Crie fluxos de trabalho baseados em IA para resumir textos, gerar textos ou enviar respostas para qualquer um dos mais de 70 apps que suportam a especificação x-callback-url. Nenhum código é necessário.

Uma compra, sem assinatura — Compartilhamento Familiar para seis

Abandone as assinaturas por uma escolha mais inteligente com o Private LLM. Uma única compra desbloqueia o app em todas as plataformas Apple — iPhone, iPad e Mac — permitindo o Compartilhamento Familiar para até seis parentes. Essa abordagem simplifica o acesso e amplia o valor do seu investimento, tornando a privacidade e a inteligência digital universalmente disponíveis para sua família.

Ferramentas de escrita com IA integradas ao macOS

Selecione qualquer texto em qualquer app do macOS, clique com o botão direito e o Private LLM reescreve, resume ou corrige — inteiramente no dispositivo. Suporta inglês e os principais idiomas da Europa Ocidental.

Criado por dois engenheiros, não por VCs

O Private LLM foi criado por dois engenheiros na UE — financiado por conta própria, sem capital de risco, sem roteiro de crescimento forçado. Somos o único app na App Store com quantização OmniQuant e GPTQ, que produzem resultados comprovadamente melhores do que a quantização RTN usada por apps baseados em MLX e llama.cpp, como Ollama e LM Studio. Respondemos aos usuários, não a investidores — é por isso que seus dados permanecem no dispositivo e sempre permanecerão.

Da App Store

Avaliações reais de usuários de iPhone e Mac

“This is a private AI app created by developers performing constant updates and not charging a subscription. That is rare nowadays! Bravo, looking forward to the updates as this continues to improve!”

Avaliação 1 de 5

Quantização OmniQuant e GPTQ: Melhor resultado, menos memória

O Private LLM usa OmniQuant e quantização GPTQ. Quando LLMs são quantizados para inferência no dispositivo, valores de peso discrepantes prejudicam a qualidade da geração de texto. O OmniQuant modula pesos discrepantes com um mecanismo de corte baseado em otimização que minimiza o erro de quantização. O GPTQ usa informações de segunda ordem (Hessiana) aproximadas para minimizar o erro de reconstrução nos pesos mais importantes. A quantização RTN afim usada por apps baseados em MLX, como o LM Studio, e as variantes RTN em blocos usadas por apps baseados em llama.cpp, como o Ollama, ignoram esse tipo de otimização por peso — é por isso que esses apps produzem resultados de menor qualidade no mesmo hardware Apple. Exploramos constantemente métodos avançados de quantização, um trabalho que apps baseados em motores de inferência de terceiros não podem realizar. OmniQuant e GPTQ, combinados com kernels Metal otimizados para modelos específicos, permitem que o Private LLM entregue uma geração de texto rápida e de alta qualidade no hardware Apple.

Baixe os melhores LLMs de código aberto

iOS

Modelos baseados em Qwen3 4B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em DeepSeek R1 Distill

Para iPhones/iPads com 8GB+ de RAMModelos baseados em DeepSeek R1 Distill

Para iPhones/iPads com 16GB+ de RAMModelos baseados em Meta Llama 3.2 3B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em Meta Llama 3.2 1B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em Google Gemma 3 1B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em Google Gemma 2 9B

Para iPhones/iPads com 16GB+ de RAMModelos baseados em Google Gemma 2 2B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em Meta Llama 3.1 8B

Para iPhones/iPads com 8GB+ de RAMModelos baseados em Meta Llama 3 8B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em Qwen 2.5

Para iPhones/iPads com 4GB+ de RAMModelos baseados em Qwen 2.5

Para iPhones/iPads com 8GB+ de RAMModelos baseados em Qwen 2.5

Para iPhones/iPads com 8GB+ de RAMModelos baseados em Qwen 2.5 14B

Para iPhones/iPads com 16GB+ de RAMModelos baseados em Phi-3 Mini 3.8B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em Mistral 7B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em Llama 2 7B

Para iPhones/iPads com 6GB+ de RAMModelos baseados em Phi-2 3B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em H2O Danube

Para iPhones/iPads com 4GB+ de RAMModelos baseados em StableLM 3B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em TinyLlama 1.1B

Para iPhones/iPads com 4GB+ de RAMModelos baseados em Yi 6B

Para iPhones/iPads com 6GB+ de RAMmacOS

Modelos baseados em DeepSeek R1 Distill

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em DeepSeek R1 Distill

Para Macs com Apple Silicon com 32GB+ de RAMModelos baseados em DeepSeek R1 Distill

Para Macs com Apple Silicon com 48GB+ de RAMModelos baseados em Google Gemma 3 1B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Phi-4 14B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Meta Llama 3.3 70B

Para Macs com Apple Silicon com 48GB+ de RAMModelos baseados em Meta Llama 3.2 3B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Meta Llama 3.2 1B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Meta Llama 3.1 70B

Para Macs com Apple Silicon com 64GB+ de RAMModelos baseados em Meta Llama 3.1 8B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Qwen 2.5

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Qwen 2.5 14B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Qwen3 4B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Qwen 2.5 32B

Para Macs com Apple Silicon com 24GB+ de RAMModelos baseados em Google Gemma 2 9B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Google Gemma 2 2B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Meta Llama 3 70B

Para Macs com Apple Silicon com 48GB+ de RAMModelos baseados em Meta Llama 3 8B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Phi-3 Mini 3.8B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Google Gemma

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Mixtral 8x7B

Para Macs com Apple Silicon com 32GB+ de RAMModelos baseados em Llama 33B

Para Macs com Apple Silicon com 24GB+ de RAMModelos baseados em Llama 2 13B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em CodeLlama 13B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Llama 2 7B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Solar 10.7B

Para Macs com Apple Silicon com 16GB+ de RAMModelos baseados em Phi-2 3B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Mistral 7B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em StableLM 3B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Yi 6B

Para Macs com Apple Silicon com 8GB+ de RAMModelos baseados em Yi 34B

Para Macs com Apple Silicon com 24GB+ de RAMComo podemos ajudar?

Se você tem uma dúvida ou está enfrentando um problema com o Private LLM, estamos aqui para ajudar. Basta preencher seus dados no formulário abaixo e entraremos em contato assim que possível.