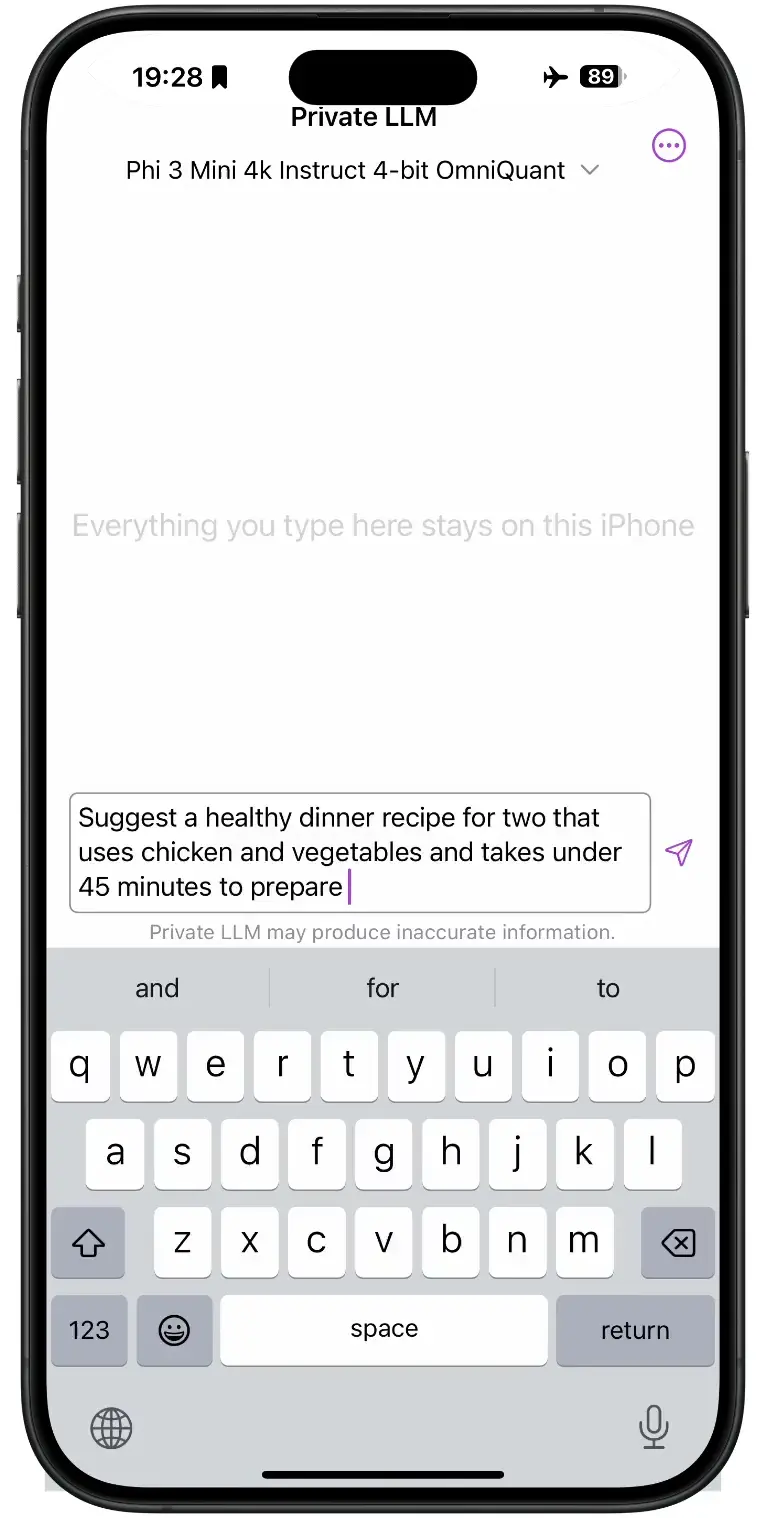

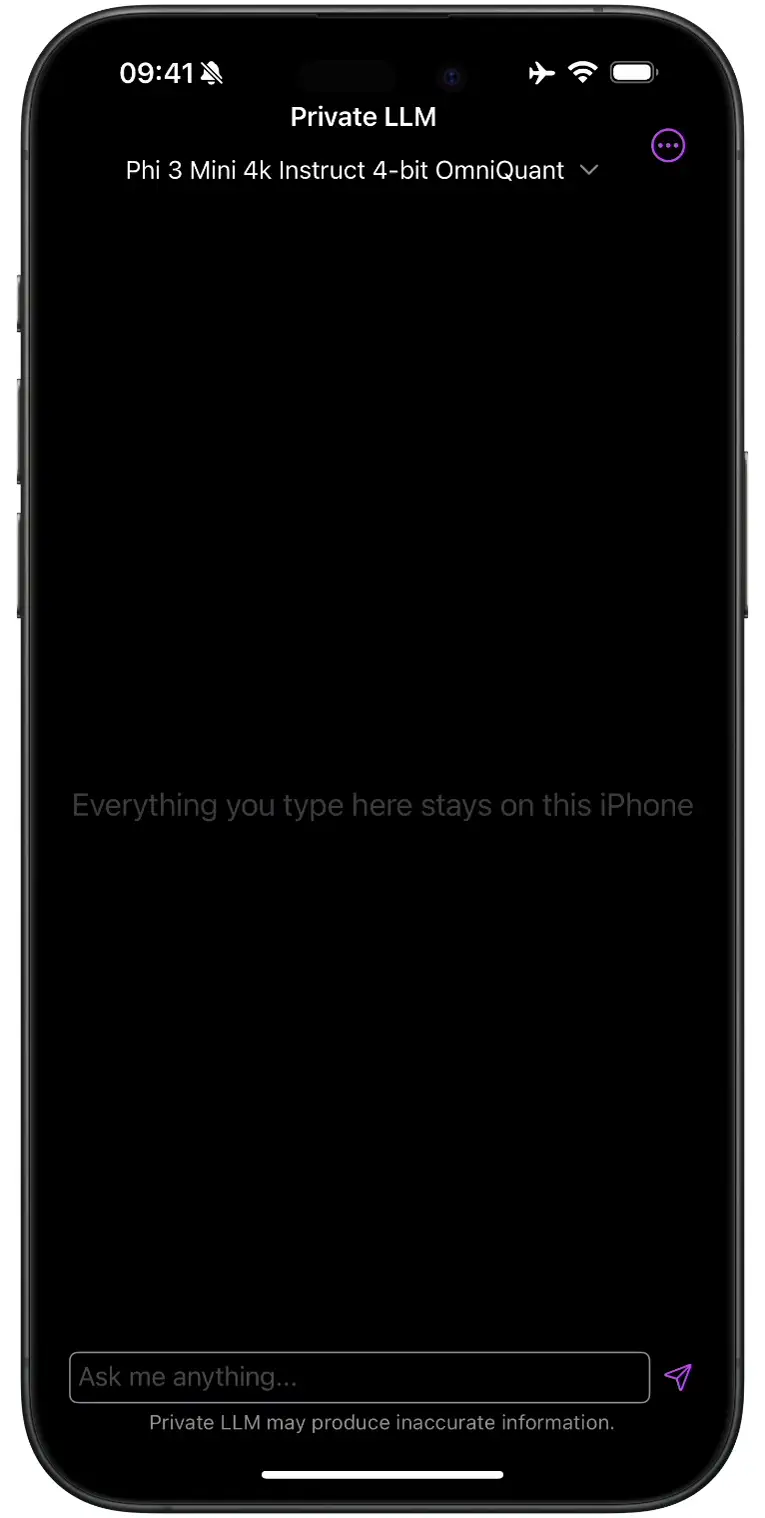

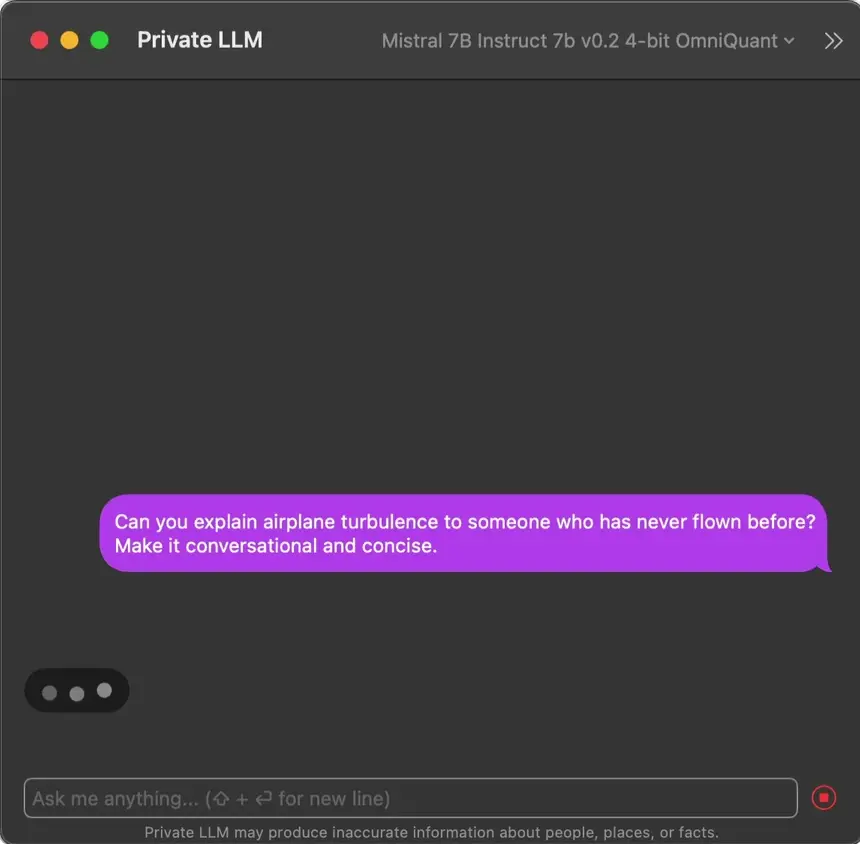

Private LLM Prywatny, nieocenzurowany czat AI na iPhone'a, iPada i Maca

Bez chmury, bez śledzenia, bez logowania.

Uruchamiaj AI offline na swoim iPhonie, iPadzie i Macu

Private LLM działa w całości na Twoim iPhonie, iPadzie lub Macu. Twoje rozmowy nigdy nie opuszczają urządzenia, a po pobraniu modelu nie jest wymagany internet. Brak konta, brak śledzenia, brak logów. Jeden zakup odblokowuje aplikację na każdym posiadanym urządzeniu Apple oraz w ramach Chmury rodzinnej.

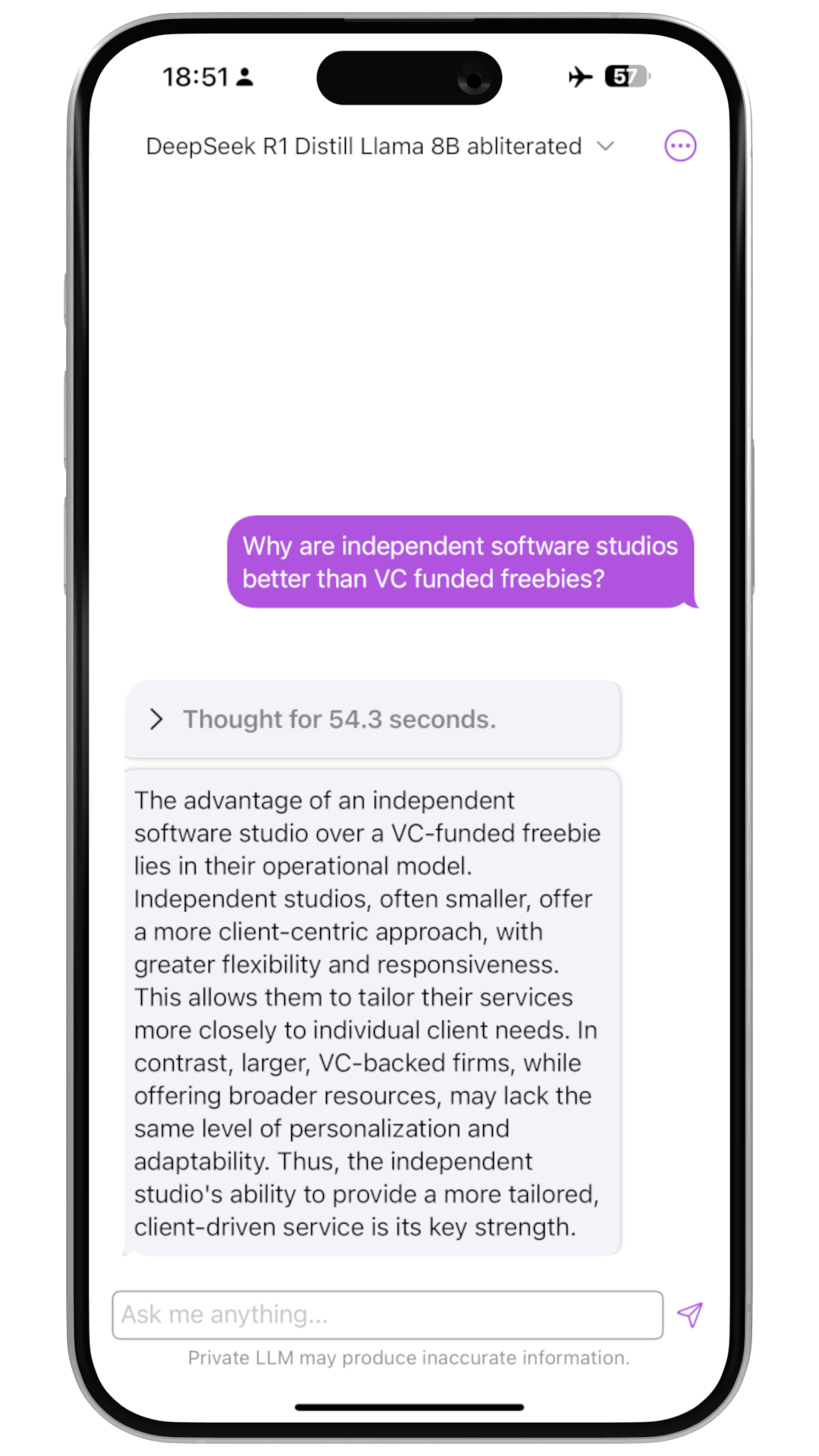

Uruchamiaj lokalnie DeepSeek R1, Llama 3.3, Qwen3 i Gemma 3

Private LLM uruchamia wiodące modele open-source bezpośrednio na Twoich urządzeniach Apple — DeepSeek R1 Distill, Llama 3.3 70B, Qwen3 4B, Phi 4, Google Gemma 3 i inne. Każda rozmowa pozostaje na urządzeniu, a każdy model jest kwantyzowany wewnętrznie dla uzyskania najlepszej możliwej jakości na Twoim sprzęcie.

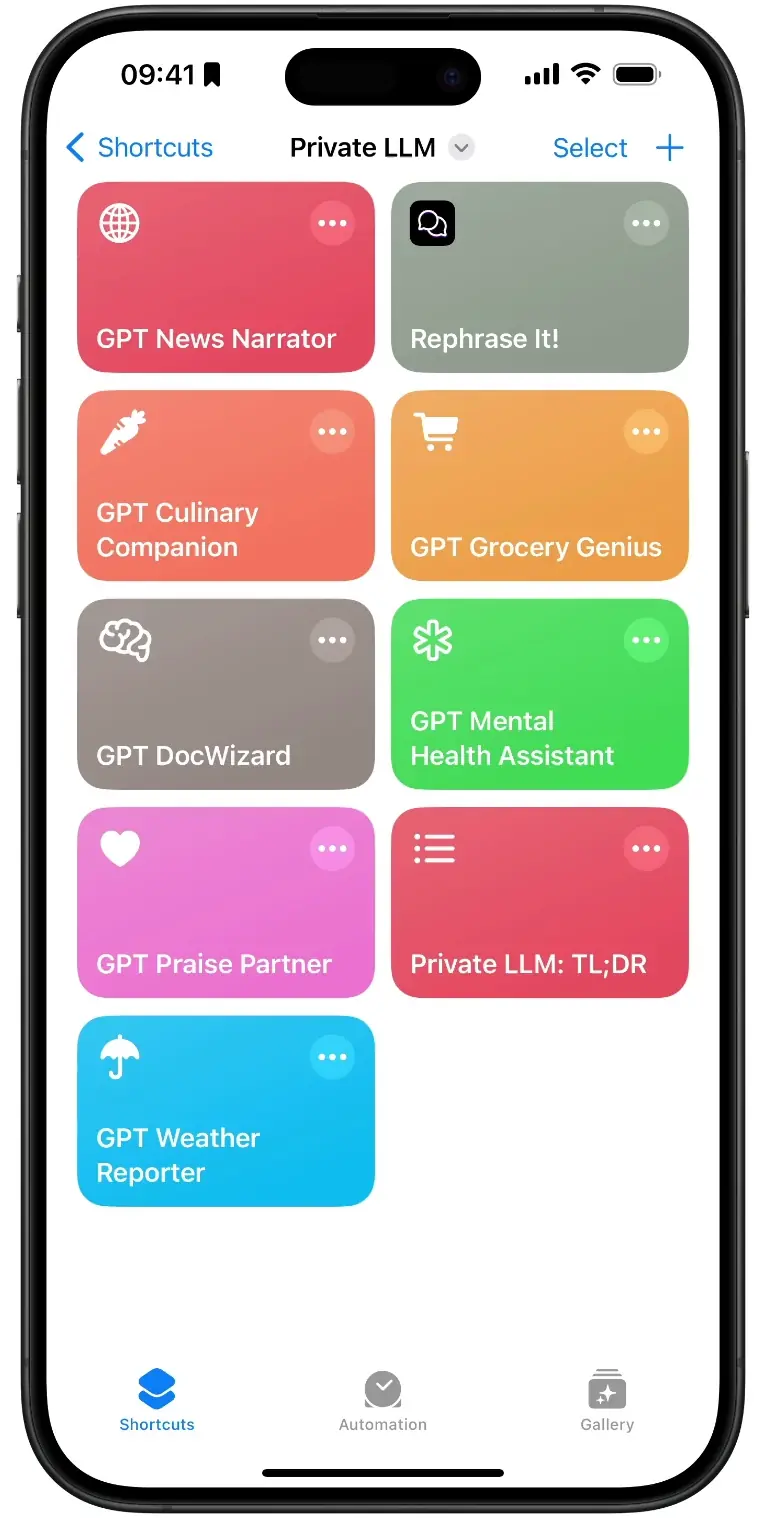

Lokalne AI w Siri i Skrótach Apple — bez kodowania

Private LLM łączy się bezpośrednio z Siri i aplikacją Skróty. Twórz przepływy pracy oparte na AI, które podsumowują tekst, generują pisma lub przesyłają odpowiedzi do dowolnej z ponad 70 aplikacji obsługujących specyfikację x-callback-url. Nie wymaga kodowania.

Jeden zakup, brak subskrypcji — Chmura rodzinna dla sześciu osób

Zrezygnuj z subskrypcji na rzecz lepszego wyboru z Private LLM. Pojedynczy zakup odblokowuje aplikację na wszystkich platformach Apple — iPhone, iPad i Mac — umożliwiając jednocześnie korzystanie z Chmury rodzinnej dla maksymalnie sześciu osób. Takie podejście nie tylko upraszcza dostęp, ale także zwiększa wartość Twojej inwestycji, czyniąc cyfrową prywatność i inteligencję powszechnie dostępnymi w Twojej rodzinie.

Narzędzia do pisania AI wbudowane w macOS

Zaznacz dowolny tekst w dowolnej aplikacji na macOS, kliknij prawym przyciskiem myszy, a Private LLM go przeredaguje, podsumuje lub poprawi — w całości na urządzeniu. Obsługuje język angielski i główne języki zachodnioeuropejskie.

Stworzone przez dwóch inżynierów, nie przez fundusze VC

Private LLM jest tworzone przez dwóch inżynierów w UE — bootstrapped, bez finansowania VC, bez planów wzrostu opartych na hackowaniu. Jesteśmy jedyną aplikacją w App Store z kwantyzacją OmniQuant i GPTQ, które zapewniają wymiernie lepsze wyniki niż kwantyzacja RTN stosowana przez MLX i aplikacje typu wrapper dla llama.cpp, takie jak Ollama i LM Studio. Odpowiadamy przed użytkownikami, a nie inwestorami — dlatego Twoje dane pozostają na urządzeniu i zawsze tak pozostanie.

Z App Store

Prawdziwe opinie użytkowników iPhone'a i Maca

“This is a private AI app created by developers performing constant updates and not charging a subscription. That is rare nowadays! Bravo, looking forward to the updates as this continues to improve!”

Opinia 1 z 5

Kwantyzacja OmniQuant i GPTQ: Lepsza jakość, mniej pamięci

Private LLM wykorzystuje kwantyzację OmniQuant i GPTQ. Kiedy modele LLM są kwantyzowane do wnioskowania na urządzeniu, wartości odstające wag wpływają negatywnie na jakość generowania tekstu. OmniQuant moduluje wagi odstające za pomocą mechanizmu przycinania opartego na optymalizacji, który minimalizuje błąd kwantyzacji. GPTQ wykorzystuje przybliżone informacje drugiego rzędu (Hessian) do minimalizacji błędu rekonstrukcji wag, które mają największe znaczenie. Kwantyzacja afiniczna RTN stosowana przez aplikacje oparte na MLX, takie jak LM Studio, oraz warianty blokowe RTN stosowane przez aplikacje oparte na llama.cpp, takie jak Ollama, pomijają ten rodzaj optymalizacji wag — dlatego te aplikacje generują niższej jakości wyniki na tym samym sprzęcie Apple. Stale badamy zaawansowane metody kwantyzacji, co jest pracą, której aplikacje typu wrapper zbudowane na silnikach wnioskowania stron trzecich nie mogą podjąć. OmniQuant i GPTQ w połączeniu ze zoptymalizowanymi jądrami Metal dla konkretnych modeli pozwalają Private LLM dostarczać generowanie tekstu, które jest jednocześnie szybkie i wysokiej jakości na sprzęcie Apple.

Pobierz najlepsze modele LLM open-source

iOS

Modele oparte na Qwen3 4B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na DeepSeek R1 Distill

Dla iPhone'ów/iPadów z 8GB+ pamięci RAMModele oparte na DeepSeek R1 Distill

Dla iPhone'ów/iPadów z 16GB+ pamięci RAMModele oparte na Meta Llama 3.2 3B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na Meta Llama 3.2 1B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na Google Gemma 3 1B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na Google Gemma 2 9B

Dla iPhone'ów/iPadów z 16GB+ pamięci RAMModele oparte na Google Gemma 2 2B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na Meta Llama 3.1 8B

Dla iPhone'ów/iPadów z 8GB+ pamięci RAMModele oparte na Meta Llama 3 8B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na Qwen 2.5

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na Qwen 2.5

Dla iPhone'ów/iPadów z 8GB+ pamięci RAMModele oparte na Qwen 2.5

Dla iPhone'ów/iPadów z 8GB+ pamięci RAMModele oparte na Qwen 2.5 14B

Dla iPhone'ów/iPadów z 16GB+ pamięci RAMModele oparte na Phi-3 Mini 3.8B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na Mistral 7B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na Llama 2 7B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMModele oparte na Phi-2 3B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na H2O Danube

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na StableLM 3B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na TinyLlama 1.1B

Dla iPhone'ów/iPadów z 4GB+ pamięci RAMModele oparte na Yi 6B

Dla iPhone'ów/iPadów z 6GB+ pamięci RAMmacOS

Modele oparte na DeepSeek R1 Distill

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na DeepSeek R1 Distill

Dla komputerów Mac z Apple Silicon z 32GB+ pamięci RAMModele oparte na DeepSeek R1 Distill

Dla komputerów Mac z Apple Silicon z 48GB+ pamięci RAMModele oparte na Google Gemma 3 1B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Phi-4 14B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Meta Llama 3.3 70B

Dla komputerów Mac z Apple Silicon z 48GB+ pamięci RAMModele oparte na Meta Llama 3.2 3B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Meta Llama 3.2 1B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Meta Llama 3.1 70B

Dla komputerów Mac z Apple Silicon z 64GB+ pamięci RAMModele oparte na Meta Llama 3.1 8B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Qwen 2.5

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Qwen 2.5 14B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Qwen3 4B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Qwen 2.5 32B

Dla komputerów Mac z Apple Silicon z 24GB+ pamięci RAMModele oparte na Google Gemma 2 9B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Google Gemma 2 2B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Meta Llama 3 70B

Dla komputerów Mac z Apple Silicon z 48GB+ pamięci RAMModele oparte na Meta Llama 3 8B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Phi-3 Mini 3.8B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Google Gemma

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Mixtral 8x7B

Dla komputerów Mac z Apple Silicon z 32GB+ pamięci RAMModele oparte na Llama 33B

Dla komputerów Mac z Apple Silicon z 24GB+ pamięci RAMModele oparte na Llama 2 13B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na CodeLlama 13B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Llama 2 7B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Solar 10.7B

Dla komputerów Mac z Apple Silicon z 16GB+ pamięci RAMModele oparte na Phi-2 3B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Mistral 7B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na StableLM 3B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Yi 6B

Dla komputerów Mac z Apple Silicon z 8GB+ pamięci RAMModele oparte na Yi 34B

Dla komputerów Mac z Apple Silicon z 24GB+ pamięci RAMW czym możemy pomóc?

Niezależnie od tego, czy masz pytanie, czy napotkałeś problem z Private LLM, jesteśmy tutaj, aby pomóc. Po prostu podaj swoje dane w poniższym formularzu, a my odpowiemy najszybciej, jak to możliwe.