Private LLM Chat AI privata e non censurata per iPhone, iPad e Mac

Niente cloud, niente tracciamento, niente login.

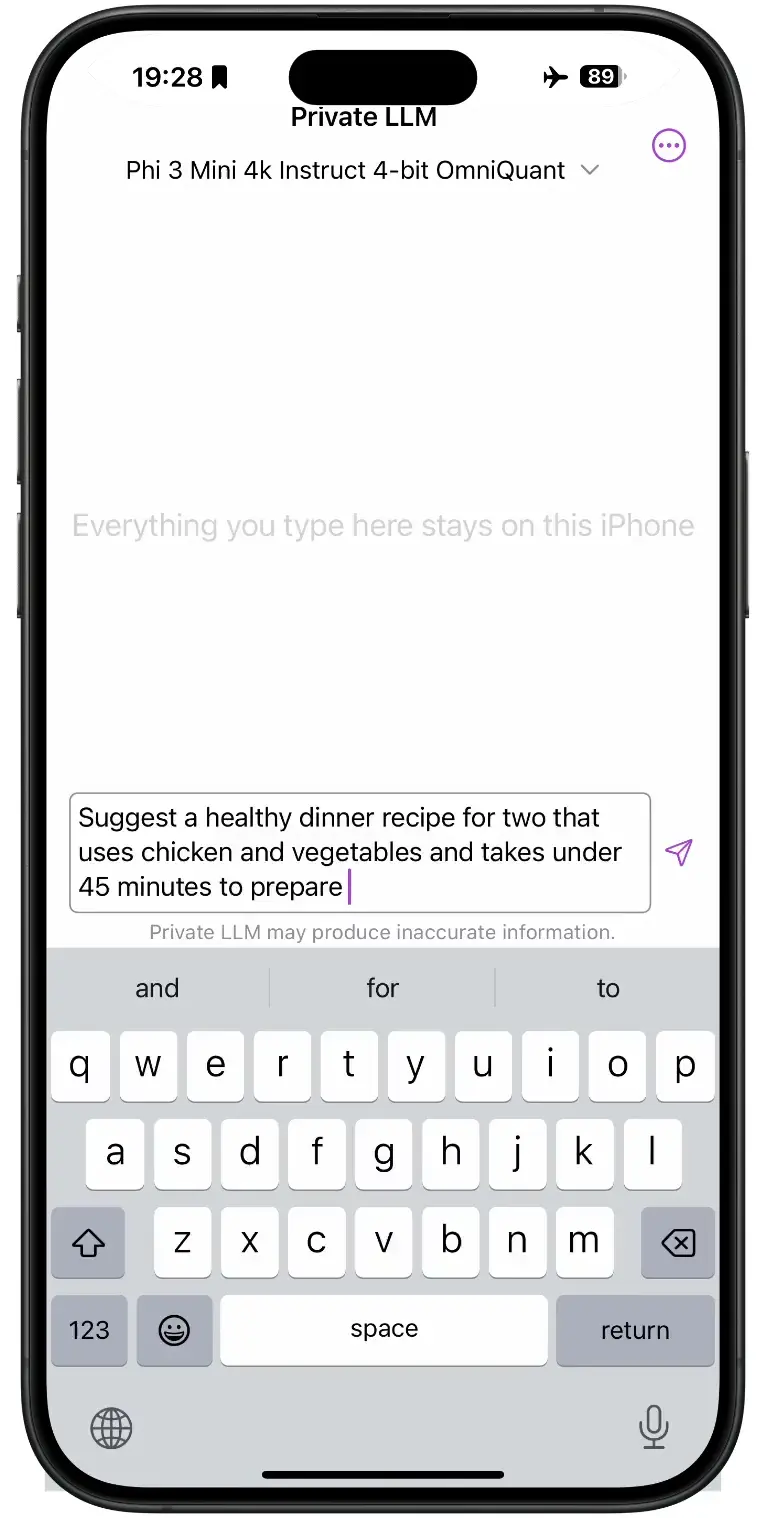

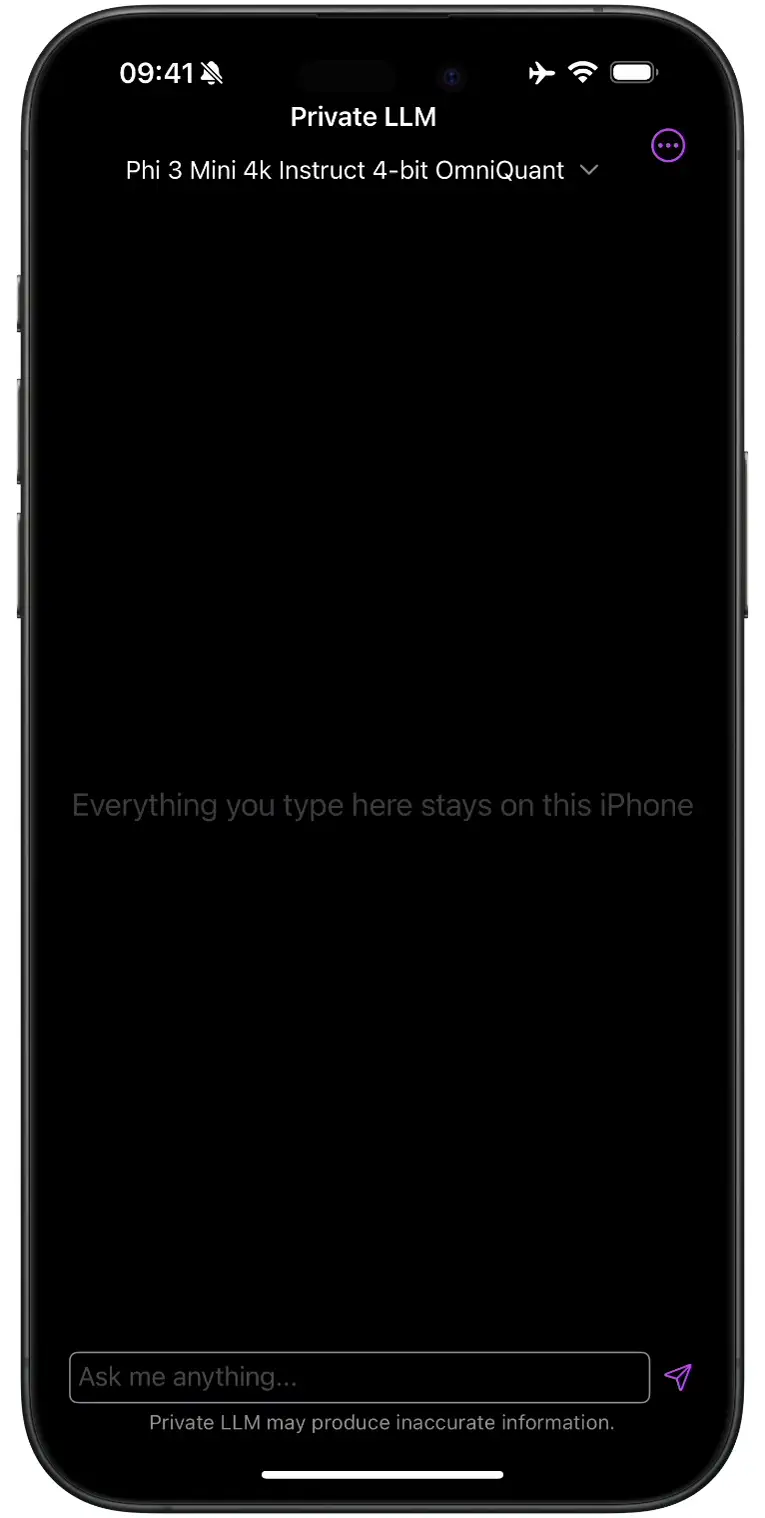

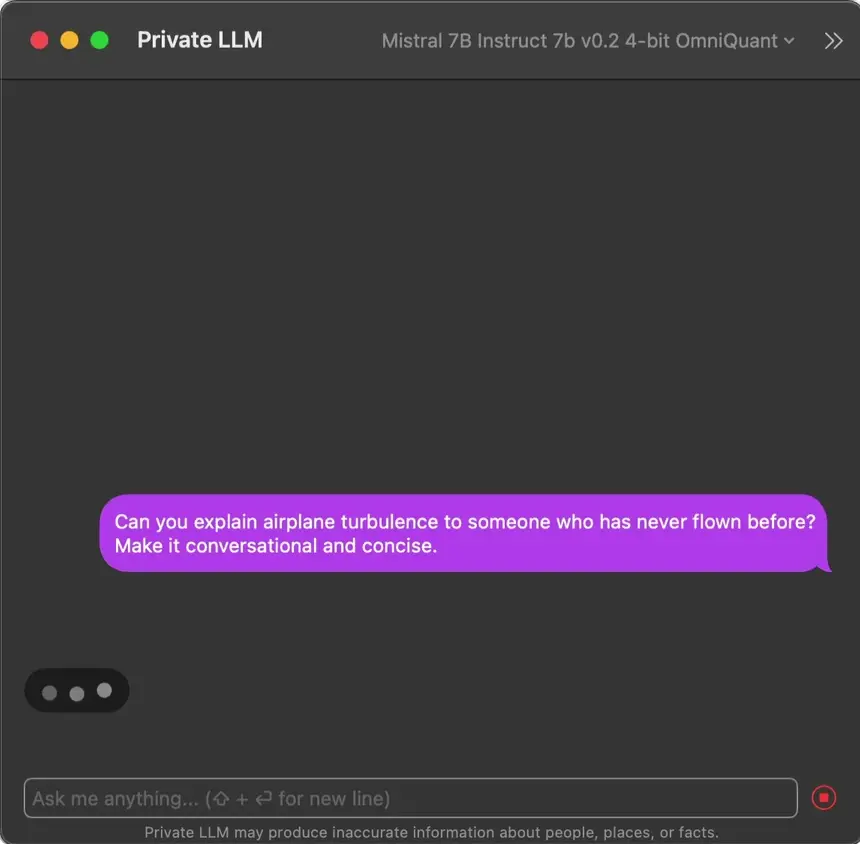

Esegui l'AI offline sul tuo iPhone, iPad e Mac

Private LLM funziona interamente sul tuo iPhone, iPad o Mac. Le tue conversazioni non lasciano mai il dispositivo e non è richiesta alcuna connessione internet dopo il primo download del modello. Nessun account, nessun tracciamento, nessun log. Un unico acquisto sblocca l'app su ogni dispositivo Apple che possiedi e nel tuo gruppo di In famiglia.

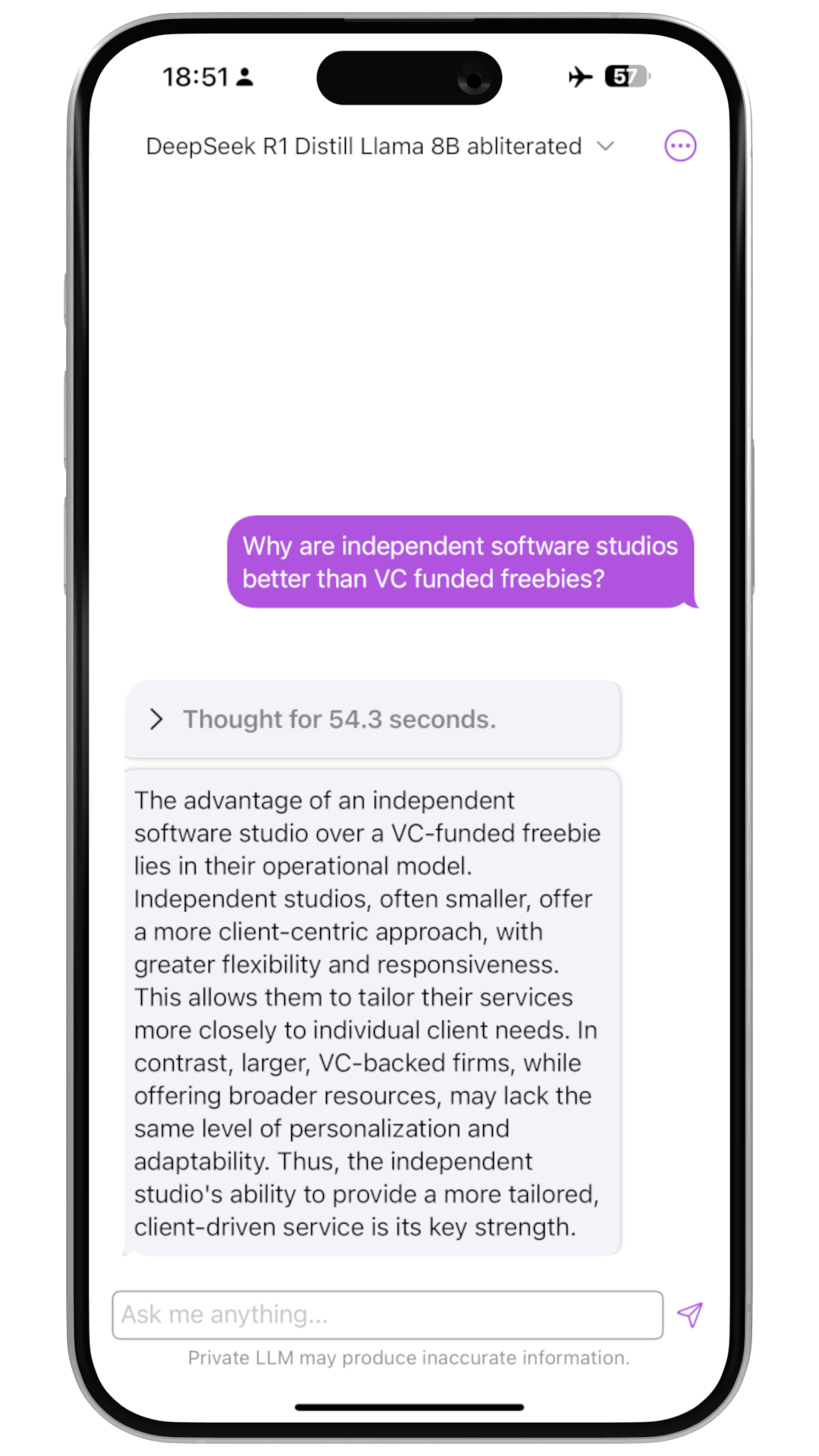

Esegui DeepSeek R1, Llama 3.3, Qwen3 e Gemma 3 localmente

Private LLM esegue i principali modelli open-source direttamente sui tuoi dispositivi Apple: DeepSeek R1 Distill, Llama 3.3 70B, Qwen3 4B, Phi 4, Google Gemma 3 e altri. Ogni conversazione rimane sul dispositivo e ogni modello è quantizzato internamente per la migliore qualità possibile sul tuo hardware.

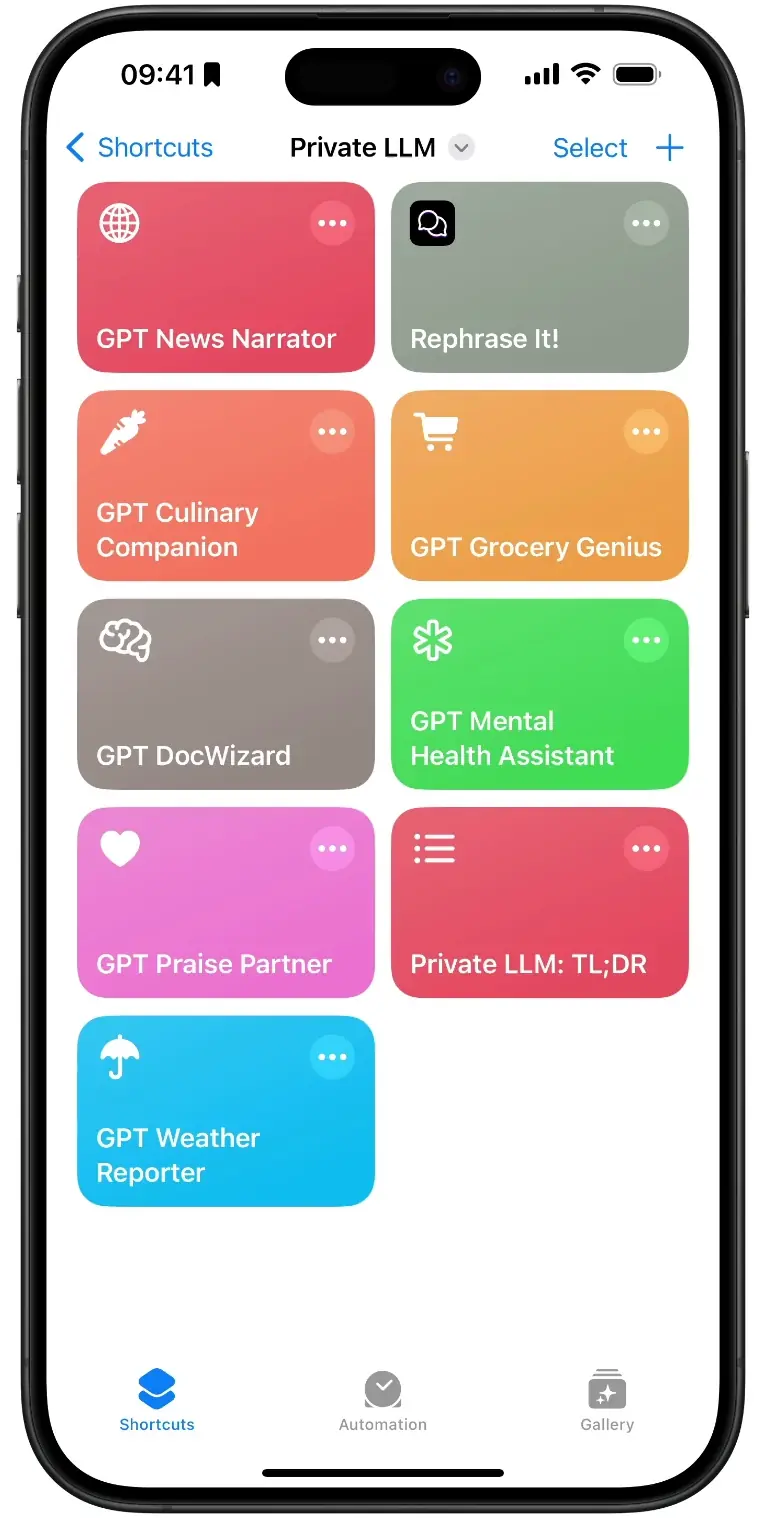

AI locale in Siri e Apple Shortcuts — Senza codice

Private LLM si collega direttamente a Siri e all'app Shortcuts. Crea flussi di lavoro basati sull'AI per riassumere testi, generare contenuti o inviare risposte a una qualsiasi delle oltre 70 app che supportano la specifica x-callback-url. Non è richiesto alcun codice.

Un acquisto, nessun abbonamento — In famiglia per sei persone

Abbandona gli abbonamenti per una scelta più intelligente con Private LLM. Un singolo acquisto sblocca l'app su tutte le piattaforme Apple—iPhone, iPad e Mac—abilitando al contempo In famiglia per un massimo di sei parenti. Questo approccio non solo semplifica l'accesso, ma aumenta anche il valore del tuo investimento, rendendo la privacy digitale e l'intelligenza universalmente disponibili nella tua famiglia.

Strumenti di scrittura AI integrati in macOS

Seleziona qualsiasi testo in un'app macOS, fai clic con il tasto destro e Private LLM lo riscriverà, riassumerà o correggerà, interamente sul dispositivo. Supporta l'inglese e le principali lingue dell'Europa occidentale.

Creato da due ingegneri, non da VC

Private LLM è creato da due ingegneri nell'UE: autofinanziato, senza fondi di venture capital, senza roadmap di crescita forzata. Siamo l'unica app sull'App Store con quantizzazione OmniQuant e GPTQ, che producono risultati misurabilmente migliori rispetto alla quantizzazione RTN utilizzata dalle app wrapper MLX e llama.cpp come Ollama e LM Studio. Rispondiamo agli utenti, non agli investitori: ecco perché i tuoi dati rimangono sul dispositivo e lo faranno sempre.

Dall'App Store

Recensioni reali da utenti iPhone e Mac

“This is a private AI app created by developers performing constant updates and not charging a subscription. That is rare nowadays! Bravo, looking forward to the updates as this continues to improve!”

Recensione 1 di 5

Quantizzazione OmniQuant e GPTQ: output migliore, meno memoria

Private LLM utilizza OmniQuant e la quantizzazione GPTQ. Quando gli LLM vengono quantizzati per l'inferenza sul dispositivo, i valori di peso anomali compromettono la qualità della generazione del testo. OmniQuant modula i pesi anomali con un meccanismo di clipping basato sull'ottimizzazione che riduce al minimo l'errore di quantizzazione. GPTQ utilizza informazioni approssimative del secondo ordine (Hessian) per ridurre al minimo l'errore di ricostruzione sui pesi più importanti. La quantizzazione RTN affine utilizzata dalle app basate su MLX come LM Studio, e le varianti RTN a blocchi utilizzate dalle app basate su llama.cpp come Ollama, saltano questo tipo di ottimizzazione per singolo peso: ecco perché quelle app producono un output di qualità inferiore sullo stesso hardware Apple. Esploriamo costantemente metodi di quantizzazione avanzati, un lavoro che le app wrapper basate su motori di inferenza di terze parti non possono intraprendere. OmniQuant e GPTQ, abbinati a kernel Metal ottimizzati specifici per il modello, consentono a Private LLM di offrire una generazione di testo veloce e di alta qualità sull'hardware Apple.

Scarica i migliori LLM open source

iOS

Modelli basati su Qwen3 4B

Per iPhone/iPad con 6GB+ di RAMModelli basati su DeepSeek R1 Distill

Per iPhone/iPad con 8GB+ di RAMModelli basati su DeepSeek R1 Distill

Per iPhone/iPad con 16GB+ di RAMModelli basati su Meta Llama 3.2 3B

Per iPhone/iPad con 6GB+ di RAMModelli basati su Meta Llama 3.2 1B

Per iPhone/iPad con 4GB+ di RAMModelli basati su Google Gemma 3 1B

Per iPhone/iPad con 4GB+ di RAMModelli basati su Google Gemma 2 9B

Per iPhone/iPad con 16GB+ di RAMModelli basati su Google Gemma 2 2B

Per iPhone/iPad con 4GB+ di RAMModelli basati su Meta Llama 3.1 8B

Per iPhone/iPad con 8GB+ di RAMModelli basati su Meta Llama 3 8B

Per iPhone/iPad con 6GB+ di RAMModelli basati su Qwen 2.5

Per iPhone/iPad con 4GB+ di RAMModelli basati su Qwen 2.5

Per iPhone/iPad con 8GB+ di RAMModelli basati su Qwen 2.5

Per iPhone/iPad con 8GB+ di RAMModelli basati su Qwen 2.5 14B

Per iPhone/iPad con 16GB+ di RAMModelli basati su Phi-3 Mini 3.8B

Per iPhone/iPad con 6GB+ di RAMModelli basati su Mistral 7B

Per iPhone/iPad con 6GB+ di RAMModelli basati su Phi-2 3B

Per iPhone/iPad con 4GB+ di RAMModelli basati su H2O Danube

Per iPhone/iPad con 4GB+ di RAMModelli basati su StableLM 3B

Per iPhone/iPad con 4GB+ di RAMModelli basati su TinyLlama 1.1B

Per iPhone/iPad con 4GB+ di RAMModelli basati su Yi 6B

Per iPhone/iPad con 6GB+ di RAMmacOS

Modelli basati su DeepSeek R1 Distill

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su DeepSeek R1 Distill

Per Mac con Apple Silicon e 32GB+ di RAMModelli basati su DeepSeek R1 Distill

Per Mac con Apple Silicon e 48GB+ di RAMModelli basati su Google Gemma 3 1B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Phi-4 14B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Meta Llama 3.3 70B

Per Mac con Apple Silicon e 48GB+ di RAMModelli basati su Meta Llama 3.2 3B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Meta Llama 3.2 1B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Meta Llama 3.1 70B

Per Mac con Apple Silicon e 64GB+ di RAMModelli basati su Meta Llama 3.1 8B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Qwen 2.5

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Qwen 2.5 14B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Qwen3 4B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Qwen 2.5 32B

Per Mac con Apple Silicon e 24GB+ di RAMModelli basati su Google Gemma 2 9B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Google Gemma 2 2B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Meta Llama 3 70B

Per Mac con Apple Silicon e 48GB+ di RAMModelli basati su Meta Llama 3 8B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Phi-3 Mini 3.8B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Mixtral 8x7B

Per Mac con Apple Silicon e 32GB+ di RAMModelli basati su Llama 33B

Per Mac con Apple Silicon e 24GB+ di RAMModelli basati su Llama 2 13B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su CodeLlama 13B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Llama 2 7B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Solar 10.7B

Per Mac con Apple Silicon e 16GB+ di RAMModelli basati su Phi-2 3B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Mistral 7B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su StableLM 3B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Yi 6B

Per Mac con Apple Silicon e 8GB+ di RAMModelli basati su Yi 34B

Per Mac con Apple Silicon e 24GB+ di RAMCome possiamo aiutarti?

Che tu abbia una domanda o stia riscontrando un problema con Private LLM, siamo qui per aiutarti. Inserisci i tuoi dati nel modulo sottostante e ti risponderemo il prima possibile.