Private LLM Privater, unzensierter KI-Chat für iPhone, iPad und Mac

Keine Cloud, Kein Tracking, Keine Logins.

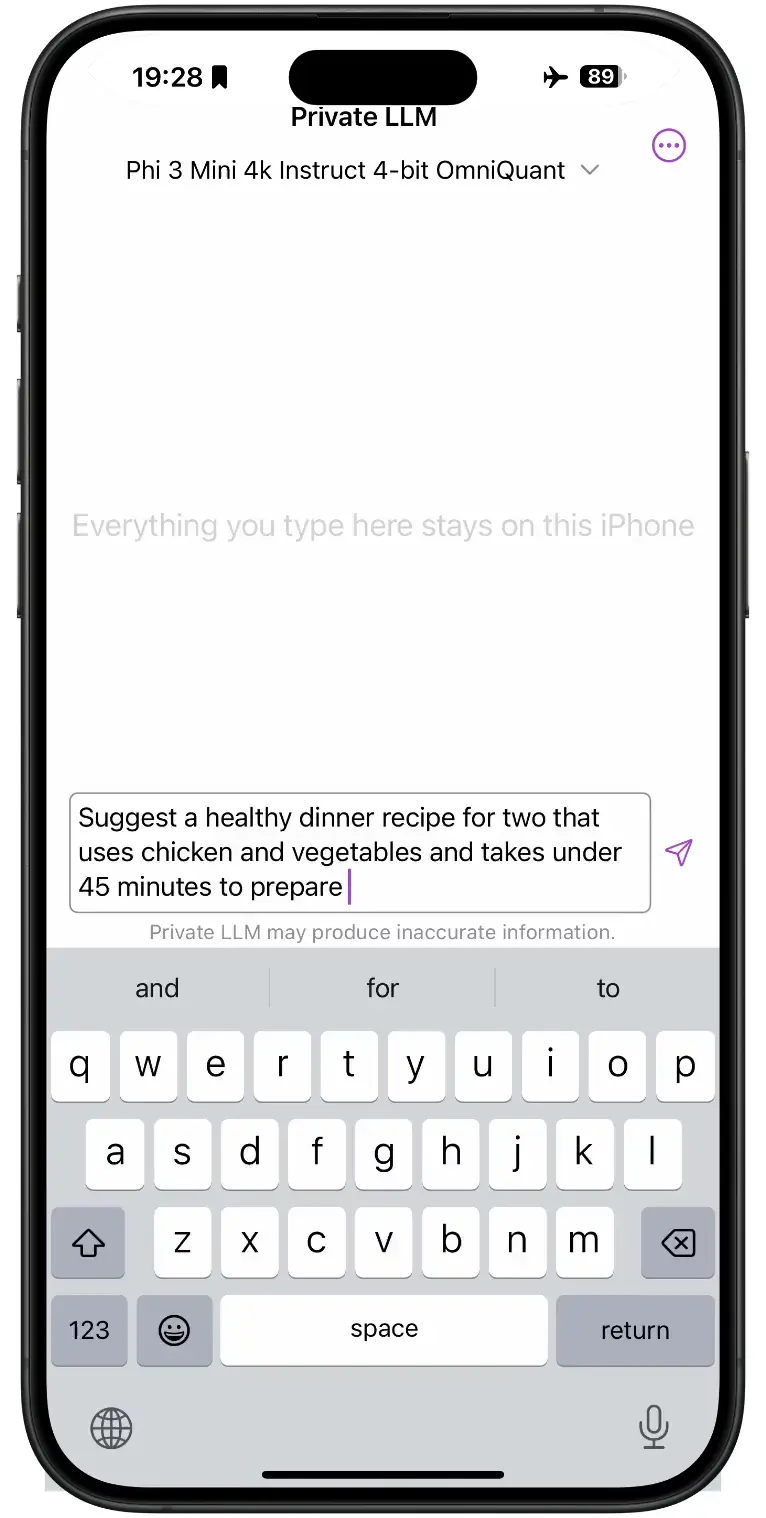

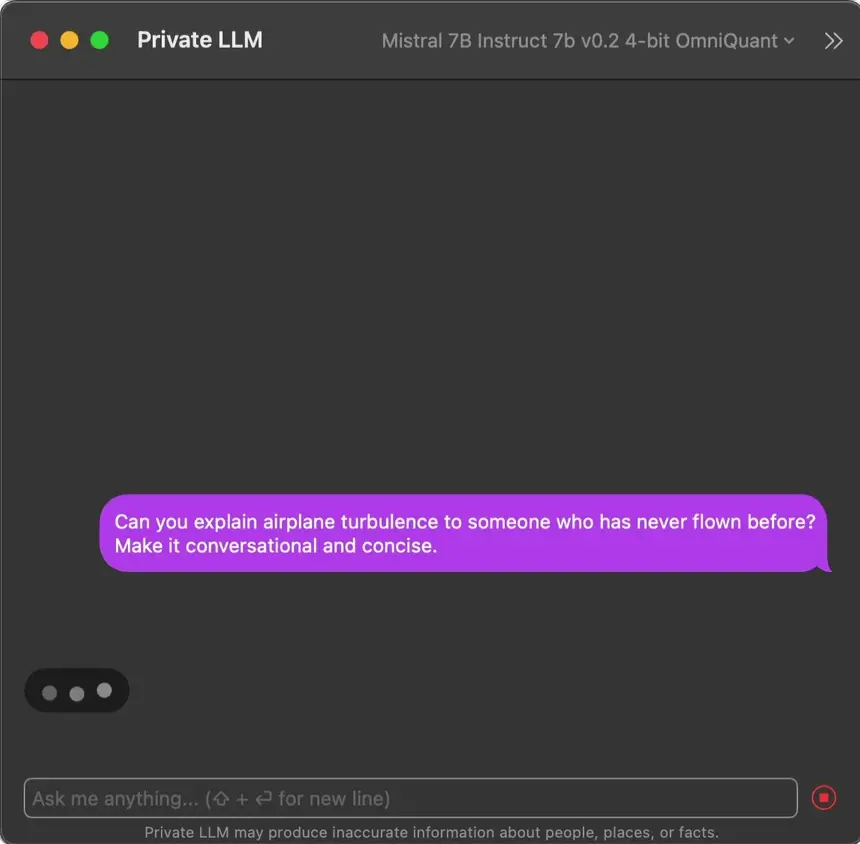

KI offline auf deinem iPhone, iPad und Mac ausführen

Private LLM läuft komplett auf deinem iPhone, iPad oder Mac. Deine Unterhaltungen verlassen niemals das Gerät, und nach dem ersten Modell-Download ist kein Internet erforderlich. Kein Account, kein Tracking, keine Logs. Ein einmaliger Kauf schaltet die App auf jedem Apple-Gerät frei, das du besitzt, sowie für deine Familienfreigabe-Gruppe.

DeepSeek R1, Llama 3.3, Qwen3 und Gemma 3 lokal ausführen

Private LLM führt die führenden Open-Source-Modelle direkt auf deinen Apple-Geräten aus - DeepSeek R1 Distill, Llama 3.3 70B, Qwen3 4B, Phi 4, Google Gemma 3 und mehr. Jede Unterhaltung bleibt on-device, und jedes Modell wird intern quantisiert, um die bestmögliche Qualität auf deiner Hardware zu gewährleisten.

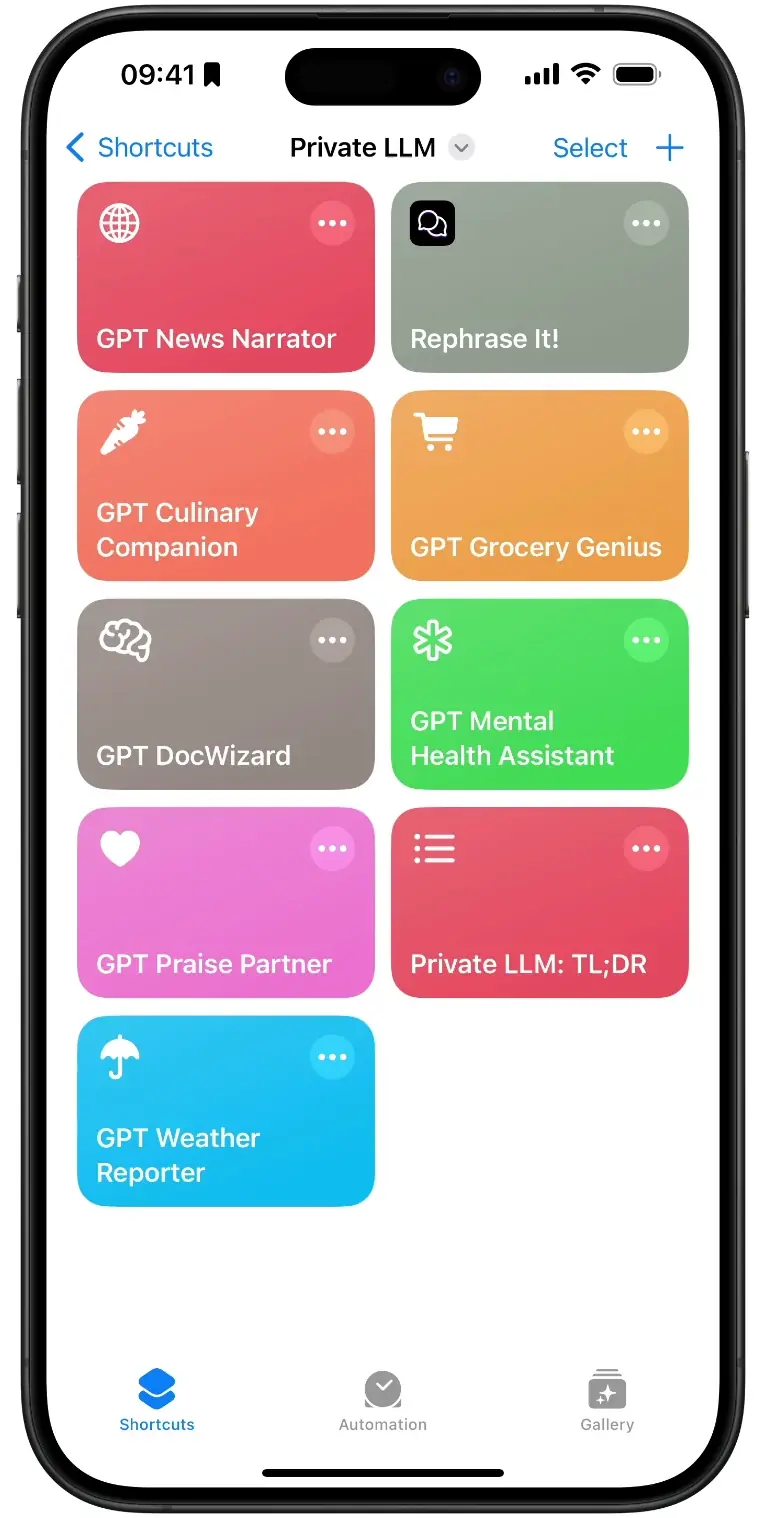

Lokale KI in Siri und Apple Shortcuts - Ohne Code

Private LLM integriert sich direkt in Siri und die Shortcuts-App. Erstelle KI-gesteuerte Workflows, die Texte zusammenfassen, Texte generieren oder Antworten in eine der über 70 Apps weiterleiten, die die x-callback-url-Spezifikation unterstützen. Kein Code erforderlich.

Einmaliger Kauf, kein Abo - Familienfreigabe für sechs Personen

Verzichten Sie auf Abonnements für eine klügere Wahl mit Private LLM. Ein einzelner Kauf schaltet die App auf allen Apple-Plattformen frei – iPhone, iPad und Mac – und ermöglicht Family Sharing für bis zu sechs Verwandte. Dieser Ansatz vereinfacht nicht nur den Zugang, sondern erhöht auch den Wert Ihrer Investition und macht digitale Privatsphäre und Intelligenz universell in Ihrer Familie verfügbar.

In macOS integrierte KI-Schreibwerkzeuge

Wähle beliebigen Text in einer beliebigen macOS-App aus, mache einen Rechtsklick, und Private LLM schreibt ihn neu, fasst ihn zusammen oder korrigiert ihn - komplett on-device. Unterstützt Englisch und die wichtigsten westeuropäischen Sprachen.

Entwickelt von zwei Ingenieuren, nicht von VCs

Private LLM wird von zwei Ingenieuren in der EU entwickelt - bootstrapped, keine VC-Finanzierung, keine Growth-Hacking-Roadmap. Wir sind die einzige App im App Store mit OmniQuant- und GPTQ-Quantisierung, die messbar bessere Ergebnisse liefern als die RTN-Quantisierung, die von MLX- und llama.cpp-Wrapper-Apps wie Ollama und LM Studio verwendet wird. Wir sind unseren Nutzern verantwortlich, nicht Investoren - deshalb bleiben deine Daten on-device und werden es immer bleiben.

Aus dem App Store

Echte Rezensionen von iPhone- und Mac-Nutzern

“This is a private AI app created by developers performing constant updates and not charging a subscription. That is rare nowadays! Bravo, looking forward to the updates as this continues to improve!”

Rezension 1 von 5

OmniQuant- und GPTQ-Quantisierung: Bessere Ergebnisse, weniger Speicherbedarf

Private LLM verwendet OmniQuant- und GPTQ-Quantisierung. Wenn LLMs für die On-Device-Inferenz quantisiert werden, beeinträchtigen Ausreißer-Gewichtungswerte die Qualität der Textgenerierung. OmniQuant moduliert Ausreißer-Gewichte mit einem lernbaren, optimierungsbasierten Clipping-Mechanismus, der den Quantisierungsfehler minimiert. GPTQ nutzt approximierte Informationen zweiter Ordnung (Hesse-Matrix), um den Rekonstruktionsfehler bei den wichtigsten Gewichten zu minimieren. Die affine RTN-Quantisierung, die von MLX-basierten Apps wie LM Studio verwendet wird, und die blockweisen RTN-Varianten, die von llama.cpp-basierten Apps wie Ollama verwendet werden, überspringen diese Art der Optimierung pro Gewicht - weshalb diese Apps auf derselben Apple-Hardware eine geringere Ausgabequalität liefern. Wir erforschen ständig fortschrittliche Quantisierungsmethoden, eine Arbeit, die Wrapper-Apps, die auf Inferenz-Engines von Drittanbietern basieren, nicht übernehmen können. OmniQuant und GPTQ in Kombination mit optimierten modellspezifischen Metal-Kerneln ermöglichen es Private LLM, eine Textgenerierung zu liefern, die auf Apple-Hardware sowohl schnell als auch von hoher Qualität ist.

Laden Sie die besten Open-Source-LLMs herunter

iOS

Qwen3 4B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMDeepSeek R1 Distill Basierte Modelle

Für iPhones/iPads mit 8GB+ RAMDeepSeek R1 Distill Basierte Modelle

Für iPhones/iPads mit 16GB+ RAMMeta Llama 3.2 3B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMMeta Llama 3.2 1B-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMGoogle Gemma 3 1B-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMGoogle Gemma 2 9B-basierte Modelle

Für iPhones/iPads mit 16GB+ RAMGoogle Gemma 2 2B-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMMeta Llama 3.1 8B-basierte Modelle

Für iPhones/iPads mit 8GB+ RAMMeta Llama 3 8B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMQwen 2.5-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMQwen 2.5-basierte Modelle

Für iPhones/iPads mit 8GB+ RAMQwen 2.5-basierte Modelle

Für iPhones/iPads mit 8GB+ RAMQwen 2.5 14B-basierte Modelle

Für iPhones/iPads mit 16GB+ RAMPhi-3 Mini 3.8B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMMistral 7B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMPhi-2 3B-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMH2O Danube-basierte Modelle

Für iPhones/iPads mit 4GB+ RAMStableLM 3B Basierte Modelle

Für iPhones/iPads mit 4GB+ RAMTinyLlama 1.1B Basierte Modelle

Für iPhones/iPads mit 4GB+ RAMYi 6B-basierte Modelle

Für iPhones/iPads mit 6GB+ RAMmacOS

DeepSeek R1 Distill Basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMDeepSeek R1 Distill Basierte Modelle

Für Apple Silicon Macs mit 32GB+ RAMDeepSeek R1 Distill Basierte Modelle

Für Apple Silicon Macs mit 48GB+ RAMGoogle Gemma 3 1B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMPhi-4 14B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMMeta Llama 3.3 70B-basierte Modelle

Für Apple Silicon Macs mit 48GB+ RAMMeta Llama 3.2 3B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMMeta Llama 3.2 1B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMMeta Llama 3.1 70B-basierte Modelle

Für Apple Silicon Macs mit 64GB+ RAMMeta Llama 3.1 8B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMQwen 2.5-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMQwen 2.5 14B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMQwen3 4B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMQwen 2.5 32B-basierte Modelle

Für Apple Silicon Macs mit 24GB+ RAMGoogle Gemma 2 9B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMGoogle Gemma 2 2B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMMeta Llama 3 70B-basierte Modelle

Für Apple Silicon Macs mit 48GB+ RAMMeta Llama 3 8B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMPhi-3 Mini 3.8B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMMixtral 8x7B-basierte Modelle

Für Apple Silicon Macs mit 32GB+ RAMLlama 33B-basierte Modelle

Für Apple Silicon Macs mit 24GB+ RAMLlama 2 13B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMCodeLlama 13B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMLlama 2 7B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMSolar 10.7B-basierte Modelle

Für Apple Silicon Macs mit 16GB+ RAMPhi-2 3B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMMistral 7B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMStableLM 3B Basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMYi 6B-basierte Modelle

Für Apple Silicon Macs mit 8GB+ RAMYi 34B-basierte Modelle

Für Apple Silicon Macs mit 24GB+ RAMWie können wir helfen?

Egal ob Sie eine Frage haben oder ein Problem mit Private LLM – wir sind für Sie da. Geben Sie einfach Ihre Daten im untenstehenden Formular ein, und wir melden uns so schnell wie möglich bei Ihnen.